Ошибки I и II рода при проверке гипотез, мощность

Общий обзор

Принятие неправильного решения

Мощность и связанные факторы

Проверка множественных гипотез

Общий обзор

Большинство проверяемых гипотез сравнивают между собой группы объектов, которые испытывают влияние различных факторов.

Например, можно сравнить эффективность двух видов лечения, чтобы сократить 5-летнюю смертность от рака молочной железы. Для данного исхода (например, смерть) сравнение, представляющее интерес (например, различные показатели смертности через 5 лет), называют эффектом или, если уместно, эффектом лечения.

Нулевую гипотезу выражают как отсутствие эффекта (например 5-летняя смертность от рака молочной железы одинаковая в двух группах, получающих разное лечение); двусторонняя альтернативная гипотеза будет означать, что различие эффектов не равно нулю.

Критериальная проверка гипотезы дает возможность определить, достаточно ли аргументов, чтобы отвергнуть нулевую гипотезу. Можно принять только одно из двух решений:

- отвергнуть нулевую гипотезу и принять альтернативную гипотезу

- остаться в рамках нулевой гипотезы

Важно: В литературе достаточно часто встречается понятие «принять нулевую гипотезу». Хотелось бы внести ясность, что со статистической точки зрения принять нулевую гипотезу невозможно, т.к. нулевая гипотеза представляет собой достаточно строгое утверждение (например, средние значения в сравниваемых группах равны ![]() ).

).

Поэтому фразу о принятии нулевой гипотезы следует понимать как то, что мы просто остаемся в рамках гипотезы.

Принятие неправильного решения

Возможно неправильное решение, когда отвергают/не отвергают нулевую гипотезу, потому что есть только выборочная информация.

| Верная гипотеза | |||

|---|---|---|---|

| H0 | H1 | ||

| Результат

применения критерия |

H0 | H0 верно принята | H0 неверно принята

(Ошибка второго рода) |

| H1 | H0 неверно отвергнута

(Ошибка первого рода) |

H0 верно отвергнута |

Ошибка 1-го рода: нулевую гипотезу отвергают, когда она истинна, и делают вывод, что имеется эффект, когда в действительности его нет. Максимальный шанс (вероятность) допустить ошибку 1-го рода обозначается α (альфа). Это уровень значимости критерия; нулевую гипотезу отвергают, если наше значение p ниже уровня значимости, т. е., если p < α.

Следует принять решение относительно значения а прежде, чем будут собраны данные; обычно назначают условное значение 0,05, хотя можно выбрать более ограничивающее значение, например 0,01.

Шанс допустить ошибку 1-го рода никогда не превысит выбранного уровня значимости, скажем α = 0,05, так как нулевую гипотезу отвергают только тогда, когда p< 0,05. Если обнаружено, что p > 0,05, то нулевую гипотезу не отвергнут и, следовательно, не допустят ошибки 1-го рода.

Ошибка 2-го рода: не отвергают нулевую гипотезу, когда она ложна, и делают вывод, что нет эффекта, тогда как в действительности он существует. Шанс возникновения ошибки 2-го рода обозначается β (бета); а величина (1-β) называется мощностью критерия.

Следовательно, мощность — это вероятность отклонения нулевой гипотезы, когда она ложна, т.е. это шанс (обычно выраженный в процентах) обнаружить реальный эффект лечения в выборке данного объема как статистически значимый.

В идеале хотелось бы, чтобы мощность критерия составляла 100%; однако это невозможно, так как всегда остается шанс, хотя и незначительный, допустить ошибку 2-го рода.

К счастью, известно, какие факторы влияют на мощность и, таким образом, можно контролировать мощность критерия, рассматривая их.

Мощность и связанные факторы

Планируя исследование, необходимо знать мощность предложенного критерия. Очевидно, можно начинать исследование, если есть «хороший» шанс обнаружить уместный эффект, если таковой существует (под «хорошим» мы подразумеваем, что мощность должна быть по крайней мере 70-80%).

Этически безответственно начинать исследование, у которого, скажем, только 40% вероятности обнаружить реальный эффект лечения; это бесполезная трата времени и денежных средств.

Ряд факторов имеют прямое отношение к мощности критерия.

Объем выборки: мощность критерия увеличивается по мере увеличения объема выборки. Это означает, что у большей выборки больше возможностей, чем у незначительной, обнаружить важный эффект, если он существует.

Когда объем выборки небольшой, у критерия может быть недостаточно мощности, чтобы обнаружить отдельный эффект. Эти методы также можно использовать для оценки мощности критерия для точно установленного объема выборки.

Вариабельность наблюдений: мощность увеличивается по мере того, как вариабельность наблюдений уменьшается.

Интересующий исследователя эффект: мощность критерия больше для более высоких эффектов. Критерий проверки гипотез имеет больше шансов обнаружить значительный реальный эффект, чем незначительный.

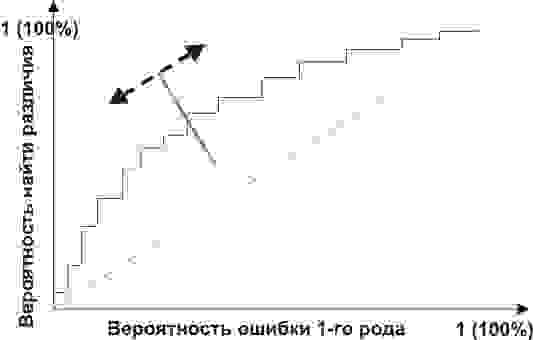

Уровень значимости: мощность будет больше, если уровень значимости выше (это эквивалентно увеличению допущения ошибки 1-го рода, α, а допущение ошибки 2-го рода, β, уменьшается).

Таким образом, вероятнее всего, исследователь обнаружит реальный эффект, если на стадии планирования решит, что будет рассматривать значение р как значимое, если оно скорее будет меньше 0,05, чем меньше 0,01.

Обратите внимание, что проверка ДИ для интересующего эффекта указывает на то, была ли мощность адекватной. Большой доверительный интервал следует из небольшой выборки и/или набора данных с существенной вариабельностью и указывает на недостаточную мощность.

Проверка множественных гипотез

Часто нужно выполнить критериальную проверку значимости множественных гипотез на наборе данных с многими переменными или существует более двух видов лечения.

Ошибка 1-го рода драматически увеличивается по мере увеличения числа сравнений, что приводит к ложным выводам относительно гипотез. Следовательно, следует проверить только небольшое число гипотез, выбранных для достижения первоначальной цели исследования и точно установленных априорно.

Можно использовать какую-нибудь форму апостериорного уточнения значения р, принимая во внимание число выполненных проверок гипотез.

Например, при подходе Бонферрони (его часто считают довольно консервативным) умножают каждое значение р на число выполненных проверок; тогда любые решения относительно значимости будут основываться на этом уточненном значении р.

Связанные определения:

p-уровень

Альтернативная гипотеза, альтернатива

Альфа-уровень

Бета-уровень

Гипотеза

Двусторонний критерий

Критерий для проверки гипотезы

Критическая область проверки гипотезы

Мощность

Мощность исследования

Мощность статистического критерия

Нулевая гипотеза

Односторонний критерий

Ошибка I рода

Ошибка II рода

Статистика критерия

Эквивалентные статистические критерии

В начало

Содержание портала

Фридман М.Н.

Лекция

на тему:

ПРОВЕРКА

СТАТИСТИЧЕСКИХ ГИПОТЕЗ.

Основой

применения на практике большинства

выводов и рекомендаций, полученных с

помощью математической статистики,

лежит так называемый принцип

практической уверенности.

Суть

его заключается в том, что при однократном

опыте редкое событие почти наверняка

не произойдет,

и можно на практике действовать так,

как будто оно вообще невозможно.

Более

строго мы можем сформулировать принцип

практической уверенности

следующим образом:

Если

вероятность

![]()

события

А в данном испытании очень мала, то при

однократном выполнении испытания можно

считать, что событие А практически

невозможно. Тогда противоположное

событие

![]()

практически достоверно, т.е обязательно

произойдет.

Вероятность

,

которой решено пренебрегать, называется

уровнем

значимости и

устанавливается в каждом отдельном

случае с учетом важности последствий,

вытекающих из наступления события А.

Так,

например, если событие А заключается

в том, что самолет не выпустит шасси при

посадке, то вряд ли мы полетим на таком

самолете, зная, что это может произойти

в 5% случаев, те если

=0.05.

Однако

для большинства экономических задач

уровень значимости

=0.05

является приемлемым.

Обратим

внимание, что в принципе практической

уверенности важно условие однократности

опыта, т.к. при многократном повторении

опыта (n

раз) вероятность появления события А

хотя бы один раз (m![]()

1)

увеличивается в

n

раз: Р(

m

1)=1-

(1-

)n![]()

n

.

2.Статистическая гипотеза и схема ее проверки.

Одним

из важнейших практических применений

математической статистики является

обоснование выбора того или иного

параметра или способа поведения,

например, выбор технологического

процесса или способа инвестиций,

эффективности управления или значимости

математической модели.

Как

правило, нас интересует некоторый

признак X

в генеральной совокупности, чей закон

распределения и (или) его параметры

неизвестны.

Любое

предположение о виде или параметрах

неизвестного закона распределения

называется статистической

гипотезой.

Статистическая

гипотеза бывает простой или сложной.

Простая

гипотеза, в отличие от сложной, полностью

определяет закон распределения случайной

величины. Например, гипотеза «случайная

величина распределена по закону Пуассона

с математическим ожиданием

![]()

=2»

является простой, а гипотеза «закон

распределения не является биномиальным»

-сложной.

Выдвинутая

гипотеза обычно обозначается

![]()

(нулевая гипотеза).

Утверждение,

которое является логическим отрицанием

гипотезы

,

называется альтернативной

, или конкурирующей.

Как

статистически проверить правильность

выдвинутой гипотезы, т.е. как разумно

сделать вывод — отвергнуть ее или нет?

Для

этого осуществляется случайная выборка

и используется некоторая случайная

величина

![]()

,

закон распределения которой известен.

Она, как правило, характеризует степень

расхождения фактически наблюдаемыми

и предполагаемыми характеристиками в

соответствии с предполагаемой гипотезой.

Значение

этой случайной величины,

![]()

![]()

,

полученное в результате выборки,

сравнивается с так называемым критическим

значением

![]()

,

которое установлено из условия: если

гипотеза

![]()

верна, то

вероятность Р (![]()

)=

мала.

Поэтому

в соответствии с принципом практической

уверенности это событие можно считать

практически невозможным.

Таким

образом, если это событие (

)

все же произошло в данном конкретном

опыте, то гипотеза

отвергается.

Появление противоположного события(![]()

![]()

)

считается совместимым с гипотезой

,

она не отвергается.

Правило,

по которому гипотеза

отвергается

или нет, называется

статистическим

критерием (

тестом). Статистические

критерии, служащие для проверки гипотез

о законе распределения, называемого

критериями согласия.

С

каждым критерием связана случайная

величина

,

называемая статистикой

данного критерия. Эта случайная величина

имеет известный закон распределения,

и она, как уже было сказано, отражает

расхождение выборочных результатов от

тех, которые соответствуют гипотезе

.

Поэтому

множество всех значений статистики

критерия разбивается на две области:

критическую (область отклонения гипотезы

) W

и область допустимых значений ( область

принятия гипотезы)

![]()

.

Если фактически наблюдаемое значение

статистики критерия попадает в критическую

область W,

то гипотезу

отвергают.

При

этом возможны следующие варианты:

Табл.1

|

Гипотеза |

Принимается |

Отвергается |

|

Верна |

Правильно |

Ошибка 1 рода |

|

Неверна |

Ошибка 2 рода |

Правильно |

Вероятность

допустить ошибку первого рода, те

отвергнуть гипотезу

,

когда она верна,

называется

уровнем

значимости,

или

размером

критерия.

Вероятность

допустить ошибку 2 рода, те принять

неверную гипотезу

,

обозначают

![]()

.

Вероятность

(1-

)

не допустить ошибку 2-го рода, т.е.

отвергнуть гипотезу

,

когда она неверна, называется

мощностью

критерия.

Вероятности

ошибок 1 и 2 рода однозначно определяются

выбором критической области. Конечно,

желательно сделать эти ошибки как можно

меньше, но, к сожалению, при фиксированном

объеме выборки уменьшение одной из них

ведет к увеличению другой.

Поэтому

при выборе критической области

руководствуются принципом: при заданном

уровне значимости

мощность критерия 1-

должна быть максимальной.

В

рамки нашего курса не входит рассмотрение

условий существования таких критериев.

Далее

мы рассмотрим конкретный пример

постановки и проверки гипотезы.

Соседние файлы в предмете [НЕСОРТИРОВАННОЕ]

- #

- #

- #

- #

- #

- #

- #

- #

- #

- #

- #

План.

1. Понятие нулевой гипотезы.

2. Общие принципы проверки статистических гипотез.

3. Понятие гипотезы в педагогике.

4.1 Понятие нулевой и альтернативной гипотезы

Поскольку статистика как

метод исследования имеет дело с данными, в которых интересующие

исследователя закономерности искажены различными случайными

факторами, большинство статистических вычислений сопровождается проверкой

некоторых предположений или гипотез об источнике этих данных.

Статистическая гипотеза – это предположение о свойствах случайных величин или событий,

которое мы хотим проверить по имеющимся данным. Примеры статистических

гипотез в педагогических исследованиях:

Гипотеза 1. Успеваемость

класса стохастически (вероятностно) зависит от уровня обучаемости

учащихся.

Гипотеза 2. Усвоение

начального курса математики не имеет существенных различий у учащихся, начавших

обучение с 6 или 7 лет.

Гипотеза 3.

Проблемное обучение в первом классе эффективнее по сравнению с традиционной

методикой обучения в отношении общего развития учащихся.

Нулевая гипотеза – это основное

проверяемое предположение, которое обычно формулируется как отсутствие

различий, отсутствие влияние фактора, отсутствие эффекта, равенство нулю

значений выборочных характеристик и т.п. Примером нулевой гипотезы в педагогике

является утверждение о том, что различие в результатах выполнения двумя

группами учащихся одной и той же контрольной работы вызвано лишь случайными

причинами.

Другое проверяемое

предположение (не всегда строго противоположное или обратное первому)

называется конкурирующей или альтернативной

гипотезой. Так, для упомянутого выше примера гипотезы Н0 в

педагогике одна из возможных альтернатив Н1 будет

определена как: уровни выполнения работы в двух группах учащихся

различны и это различие определяется влиянием неслучайных факторов, например,

тех или других методов обучения.

Выдвинутая

гипотеза может быть правильной или неправильной, поэтому возникает

необходимость проверить ее. Так как проверку производят статистическими методами,

то данная проверка называется статистической.

При проверке

статистических гипотез возможны ошибки (ошибочные суждения) двух видов:

— можно

отвергнуть нулевую гипотезу, когда она на самом деле верна (так называемая ошибка первого рода);

— можно принять нулевую

гипотезу, когда она на самом деле не верна (так называемая ошибка второго рода).

Ошибка, состоящая в принятии нулевой

гипотезы, когда она ложна, качественно отличается от ошибки, состоящей в

отвержении гипотезы, когда она истинна. Эта разница очень существенна

вследствие того, что различна значимость этих ошибок. Проиллюстрируем вышесказанное

на следующем примере.

Пример 1. Процесс производства некоторого

медицинского препарата весьма сложен. Несущественные на первый взгляд

отклонения от технологии вызывают появление высокотоксичной побочной примеси.

Токсичность этой примеси может оказаться столь высокой, что даже такое ее

количество, которое не может быть обнаружено при обычном химическом анализе,

может оказаться опасным для человека, принимающего это лекарство. В результате,

прежде чем выпускать в продажу вновь произведенную партию, ее подвергают

исследованию на токсичность биологическими методами. Малые дозы лекарства

вводятся некоторому количеству подопытных животных, например, мышей, и результат

регистрируют. Если лекарство токсично, то все или почти все животные гибнут. В

противном случае норма выживших велика.

Исследование лекарства может привести

к одному из возможных способов действия: выпустить партию в продажу (а1),

вернуть партию поставщику для доработки или, может быть, для уничтожения (а2).

Ошибки двух видов, связанные с

действиями а1 и а2 совершенно различны, различна и

важность избегания их. Сначала рассмотрим случай, когда применяется действие а1,

в то время когда предпочтительнее а2. Лекарство опасно для пациента,

в то время как оно признано безопасным. Ошибка этого вида может вызвать смерть

пациентов, употребляющих этот препарат. Это ошибка первого рода, так как нам

важнее ее избежать.

Рассмотрим случай когда

предпринимается действие а2, в то время когда а1 является

более предпочтительным. Это означает, что вследствие неточностей в проведении

эксперимента партия нетоксичного лекарства классифицировалась как опасная.

Последствия ошибки могут выражаться в финансовом убытке и в увеличении

стоимости лекарства. Однако случайное отвержение совершенно безопасного

лекарства, очевидно, менее нежелательно, чем, пусть даже изредка происходящие

гибели пациентов. Отвержение нетоксичной партии лекарства – ошибка второго

рода.

Допустимая вероятность

ошибки первого рода (Ркр) может быть равна 5% или 1% (0.05 или 0.01).

Уровень значимости – это вероятность ошибки

первого рода при принятии решения (вероятность ошибочного отклонения нулевой

гипотезы).

Альтернативные гипотезы принимаются тогда и только

тогда, когда опровергается нулевая гипотеза. Это бывает в случаях, когда

различия, скажем, в средних арифметических экспериментальной и контрольной

групп настолько значимы (статистически достоверны), что риск ошибки отвергнуть

нулевую гипотезу и принять альтернативную не превышает одного из трех принятых уровней

значимости статистического вывода:

первый уровень — 5% (р=5%); где допускается риск

ошибки в выводе в пяти случаях из ста теоретически возможных таких же

экспериментов при строго случайном отборе испытуемых для каждого эксперимента;

второй уровень — 1%, т. е. соответственно допускается

риск ошибиться только в одном случае из ста;

третий уровень — 0,1%, т. е. допускается риск ошибиться

только в одном случае из тысячи.

Последний уровень значимости предъявляет очень высокие

требования к обоснованию достоверности результатов эксперимента и потому редко

используется. В педагогических исследованиях, не нуждающихся в очень высоком

уровне достоверности, представляется разумным принять 5% уровень значимости.

Статистика критерия (Т) — некоторая функция

от исходных данных, по значению которой проверяется нулевая гипотеза. Чаще

всего статистика критерия является числовой функцией, но она может быть и любой

другой функцией, например, многомерной функцией.

Всякое правило, на основе которого отклоняется или

принимается нулевая гипотеза называется критерием для проверки данной

гипотезы. Статистический критерий (критерий) – это случайная величина,

которая служит для проверки статистических гипотез.

Критическая область – совокупность значений критерия,

при котором нулевую гипотезу отвергают. Область

принятия нулевой гипотезы (область

допустимых значений) – совокупность

значений критерия, при котором нулевую гипотезу принимают. При справедливости

нулевой гипотезы вероятность того, что статистика критерия попадает в область

принятия нулевой гипотезы должна быть равна 1-Ркр.

4.2 Общие принципы проверки статистических гипотез

Процедура проверки нулевой гипотезы в общем случае

включает следующие этапы:

1.

задается допустимая вероятность ошибки первого рода (Ркр=0,05)

2.

выбирается статистика критерия (Т)

3.

ищется область допустимых значений

4. по

исходным данным вычисляется значение статистики Т

5. если Т (статистика критерия) принадлежит

области принятия нулевой гипотезы, то нулевая гипотеза принимается (корректнее

говоря, делается заключение, что исходные данные не противоречат нулевой

гипотезе), а в противном случае нулевая гипотеза отвергается и принимается

альтернативная гипотеза. Это основной принцип проверки всех

статистических гипотез.

Обычно первые три этапа выполняют

профессиональные математики, а последние два – пользователи для своих частных

данных.

В современных статистических пакетах на

ЭВМ используются не стандартные уровни значимости, а уровни, подсчитываемые

непосредственно в процессе работы с соответствующим статистическим методом. Эти

уровни, обозначенные буквой P, могут иметь различное

числовое выражение в интервале от 0 до 1, например, 0,7 0,23 0,012. Понятно,

что в первых двух случаях полученные уровни значимости слишком велики и

говорить о том, что результат значим нельзя. В последнем случае результаты

значимы на уровне 12 тысячных. Это достоверный результат.

При проверке

статистических гипотез с помощью статистических пакетов, программа выводит на

экран вычисленное значение уровня значимости Р и подсказку о возможности

принятия или неприятия нулевой гипотезы.

Если вычисленное значение

Р превосходит выбранный уровень Ркр,

то принимается нулевая гипотеза, а в противном случае — альтернативная

гипотеза. Чем меньше вычисленное значение Р, тем более исходные данные

противоречат нулевой гипотезе.

Число степеней свободы у какого-либо параметра определяют

как число опытов, по которым рассчитан данный параметр, минус количество

одинаковых значений, найденных по этим опытам независимо друг от друга.

Величина Ф называется мощностью критерия и

представляет собой вероятность отклонения неверной нулевой гипотезы, то есть

вероятность правильного решения. Мощность критерия – вероятность

попадания критерия в критическую область при условии, что справедлива

альтернативная гипотеза. Чем больше Ф, тем вероятность ошибки 2-го рода меньше.

4.3 Понятие гипотезы в педагогике

Гипотеза исследования – методологическая характеристика

исследования, научное предположение, выдвигаемой для объяснения какого-либо

явления и требующее проверки на опыте для того, чтобы стать достоверным научным

знанием. От простого предположения гипотеза отличается рядом признаков. К ним

относят:

— соответствие фактам, на основе которых и для

обоснования которых она создана

— проверяемость

— приложимость к возможно более широкому кругу явлений

— относительная простота.

В гипотезе органически сливаются два момента:

выдвижение некоторого положения и последующее логическое и практическое

доказательство.

Педагогическая гипотеза (научное предположение о

преимуществе того или иного метода) в процессе статистического анализа

переводится на язык статистической науки и заново формулируется, по меньшей

мере, в виде двух статистических гипотез.

Возможны два типа гипотез:

первый тип — описательные гипотезы, в которых описываются

причины и возможные следствия. Второй тип — объяснительные: в

них дается объяснение возможным следствиям из определенных причин, а также

характеризуются условия, при которых эти следствия обязательно последуют, т. е.

объясняется, в силу каких факторов и условий будет данное следствие.

Описательные гипотезы не обладают предвидением, а объяснительные обладают таким

свойством. Объяснительные гипотезы выводят исследователей на предположения о

существовании определенных закономерных связей между явлениями,

факторами и условиями.

Гипотезы в педагогических

исследованиях могут предполагать, что одно из средств (или группа их) будет более

эффективным, чем другие средства. Здесь гипотетически

высказывается предположение о сравнительной эффективности средств,

способов, методов, форм обучения.

Более высокий уровень гипотетического предсказания

состоит в том, что автор исследования высказывает гипотезу о том, что какая-то

система мер будет не только лучше другой, но и из

ряда возможных систем она кажется оптимальной с точки зрения определенных

критериев. Такая гипотеза нуждается в еще более

строгом и оттого более развернутом доказательстве.

Материал из MachineLearning.

Перейти к: навигация, поиск

Содержание

- 1 Методика проверки статистических гипотез

- 2 Альтернативная методика на основе достигаемого уровня значимости

- 3 Типы критической области

- 4 Ошибки первого и второго рода

- 5 Свойства статистических критериев

- 6 Типы статистических гипотез

- 7 Типы статистических критериев

- 7.1 Критерии согласия

- 7.2 Критерии сдвига

- 7.3 Критерии нормальности

- 7.4 Критерии однородности

- 7.5 Критерии симметричности

- 7.6 Критерии тренда, стационарности и случайности

- 7.7 Критерии выбросов

- 7.8 Критерии дисперсионного анализа

- 7.9 Критерии корреляционного анализа

- 7.10 Критерии регрессионного анализа

- 8 Литература

- 9 Ссылки

Статистическая гипотеза (statistical hypothesys) — это определённое предположение о распределении вероятностей, лежащем в основе наблюдаемой выборки данных.

Проверка статистической гипотезы (testing statistical hypotheses) — это процесс принятия решения о том, противоречит ли рассматриваемая статистическая гипотеза наблюдаемой выборке данных.

Статистический тест или статистический критерий — строгое математическое правило, по которому принимается или отвергается статистическая гипотеза.

Методика проверки статистических гипотез

Пусть задана случайная выборка — последовательность

объектов из множества

.

Предполагается, что на множестве существует некоторая неизвестная вероятностная мера

.

Методика состоит в следующем.

- Формулируется нулевая гипотеза

о распределении вероятностей на множестве

. Гипотеза формулируется исходя из требований прикладной задачи. Чаще всего рассматриваются две гипотезы — основная или нулевая

и альтернативная

. Иногда альтернатива не формулируется в явном виде; тогда предполагается, что

означает «не

». Иногда рассматривается сразу несколько альтернатив. В математической статистике хорошо изучено несколько десятков «наиболее часто встречающихся» типов гипотез, и известны ещё сотни специальных вариантов и разновидностей. Примеры приводятся ниже.

- Задаётся некоторая статистика (функция выборки)

, для которой в условиях справедливости гипотезы

выводится функция распределения

и/или плотность распределения

. Вопрос о том, какую статистику надо взять для проверки той или иной гипотезы, часто не имеет однозначного ответа. Есть целый ряд требований, которым должна удовлетворять «хорошая» статистика

. Вывод функции распределения

при заданных

и

является строгой математической задачей, которая решается методами теории вероятностей; в справочниках приводятся готовые формулы для

; в статистических пакетах имеются готовые вычислительные процедуры.

- Фиксируется уровень значимости — допустимая для данной задачи вероятность ошибки первого рода, то есть того, что гипотеза на самом деле верна, но будет отвергнута процедурой проверки. Это должно быть достаточно малое число

. На практике часто полагают

.

- На множестве допустимых значений статистики

выделяется критическое множество

наименее вероятных значений статистики

, такое, что

. Вычисление границ критического множества как функции от уровня значимости

является строгой математической задачей, которая в большинстве практических случаев имеет готовое простое решение.

- Собственно статистический тест (статистический критерий) заключается в проверке условия:

Итак, статистический критерий определяется статистикой

и критическим множеством , которое зависит от уровня значимости

.

Замечание.

Если данные не противоречат нулевой гипотезе, это ещё не значит, что гипотеза верна.

Тому есть две причины.

Альтернативная методика на основе достигаемого уровня значимости

Широкое распространение методики фиксированного уровня значимости было вызвано сложностью вычисления многих статистических критериев в докомпьютерную эпоху. Чаще всего использовались таблицы, в которых для некоторых априорных уровней значимости были выписаны критические значения. В настоящее время результаты проверки гипотез чаще представляют с помощью достигаемого уровня значимости.

Достигаемый уровень значимости (пи-величина, англ. p-value) — это наименьшая величина уровня значимости,

при которой нулевая гипотеза отвергается для данного значения статистики критерия

где

— критическая область критерия.

Другая интерпретация:

достигаемый уровень значимости — это вероятность при справедливости нулевой гипотезы получить значение статистики, такое же или ещё более экстремальное, чем

Если достигаемый уровень значимости достаточно мал (близок к нулю), то нулевая гипотеза отвергается.

В частности, его можно сравнивать с фиксированным уровнем значимости;

тогда альтернативная методика будет эквивалентна классической.

Типы критической области

Обозначим через значение, которое находится из уравнения

, где

— функция распределения статистики

.

Если функция распределения непрерывная строго монотонная,

то есть обратная к ней функция:

-

.

Значение называется также

—квантилем распределения

.

На практике, как правило, используются статистики с унимодальной (имеющей форму пика) плотностью распределения.

Критические области (наименее вероятные значения статистики) соответствуют «хвостам» этого распределения.

Поэтому чаще всего возникают критические области одного из трёх типов:

- Левосторонняя критическая область:

-

- определяется интервалом

.

- пи-величина:

- определяется интервалом

- Правосторонняя критическая область:

-

- определяется интервалом

.

- пи-величина:

- определяется интервалом

- Двусторонняя критическая область:

-

- определяется двумя интервалами

- пи-величина:

- определяется двумя интервалами

Ошибки первого и второго рода

- Ошибка первого рода или «ложная тревога» (англ. type I error,

error, false positive) — когда нулевая гипотеза отвергается, хотя на самом деле она верна. Вероятность ошибки первого рода:

- Ошибка второго рода или «пропуск цели» (англ. type II error,

error, false negative) — когда нулевая гипотеза принимается, хотя на самом деле она не верна. Вероятность ошибки второго рода:

| Верная гипотеза | |||

|---|---|---|---|

| |

|

||

| Результат применения критерия |

|

|

(Ошибка второго рода) |

| |

(Ошибка первого рода) |

|

Свойства статистических критериев

Мощность критерия:

— вероятность отклонить гипотезу

, если на самом деле верна альтернативная гипотеза

.

Мощность критерия является числовой функцией от альтернативной гипотезы .

Несмещённый критерий:

для всех альтернатив

или, что то же самое,

для всех альтернатив .

Состоятельный критерий:

при

для всех альтернатив

.

Равномерно более мощный критерий.

Говорят, что критерий с мощностью является равномерно более мощным, чем критерий с мощностью

, если выполняются два условия:

;

для всех рассматриваемых альтернатив

, причём хотя бы для одной альтернативы неравенство строгое.

Типы статистических гипотез

- Простая гипотеза однозначно определяет функцию распределения на множестве

. Простые гипотезы имеют узкую область применения, ограниченную критериями согласия (см. ниже). Для простых гипотез известен общий вид равномерно более мощного критерия (Теорема Неймана-Пирсона).

- Сложная гипотеза утверждает принадлежность распределения к некоторому множеству распределений на

. Для сложных гипотез вывести равномерно более мощный критерий удаётся лишь в некоторых специальных случаях.

Типы статистических критериев

В зависимости от проверяемой нулевой гипотезы статистические критерии делятся на группы, перечисленные ниже по разделам.

Наряду с нулевой гипотезой, которая принимается или отвергается по результату анализа выборки, статистические критерии могут опираться на дополнительные предположения, которые априори предпологаются выполненными.

- Параметрические критерии предполагают, что выборка порождена распределением из заданного параметрического семейства. В частности, существует много критериев, предназначенных для анализа выборок из нормального распределения. Преимущество этих критериев в том, что они более мощные. Если выборка действительно удовлетворяет дополнительным предположениям, то параметрические критерии дают более точные результаты. Однако если выборка им не удовлетворяет, то вероятность ошибок (как I, так и II рода) может резко возрасти. Прежде чем применять такие критерии, необходимо убедиться, что выборка удовлетворяет дополнительным предположениям. Гипотезы о виде распределения проверяются с помощью критериев согласия.

- Непараметрические критерии не опираются на дополнительные предположения о распределении. В частности, к этому типу критериев относится большинство ранговых критериев.

Критерии согласия

Критерии согласия проверяют, согласуется ли заданная выборка с заданным фиксированным распределением, с заданным параметрическим семейством распределений, или с другой выборкой.

- Критерий Колмогорова-Смирнова

- Критерий хи-квадрат (Пирсона)

- Критерий омега-квадрат (фон Мизеса)

Критерии сдвига

Специальный случай двухвыборочных критериев согласия.

Проверяется гипотеза сдвига, согласно которой распределения двух выборок имеют одинаковую форму и отличаются только сдвигом на константу.

- Критерий Стьюдента

- Критерий Уилкоксона-Манна-Уитни

Критерии нормальности

Критерии нормальности — это выделенный частный случай критериев согласия.

Нормально распределённые величины часто встречаются в прикладных задачах, что обусловлено действием закона больших чисел.

Если про выборки заранее известно, что они подчиняются нормальному распределению, то к ним становится возможно применять более мощные параметрические критерии.

Проверка нормальность часто выполняется на первом шаге анализа выборки, чтобы решить, использовать далее параметрические методы или непараметрические.

В справочнике А. И. Кобзаря приведена сравнительная таблица мощности для 21 критерия нормальности.

- Критерий Шапиро-Уилка

- Критерий асимметрии и эксцесса

Критерии однородности

Критерии однородности предназначены для проверки нулевой гипотезы о том, что

две выборки (или несколько) взяты из одного распределения,

либо их распределения имеют одинаковые значения математического ожидания, дисперсии, или других параметров.

Критерии симметричности

Критерии симметричности позволяют проверить симметричность распределения.

- Одновыборочный критерий Уилкоксона и его модификации: критерий Антилла-Кёрстинга-Цуккини, критерий Бхаттачария-Гаствирса-Райта

- Критерий знаков

- Коэффициент асимметрии

Критерии тренда, стационарности и случайности

Критерии тренда и случайности предназначены для проверки нулевой гипотезы об

отсутствии зависимости между выборочными данными и номером наблюдения в выборке.

Они часто применяются в анализе временных рядов, в частности, при анализе регрессионных остатков.

Критерии выбросов

Критерии дисперсионного анализа

Критерии корреляционного анализа

Критерии регрессионного анализа

Литература

- Вероятность и математическая статистика: Энциклопедия / Под ред. Ю.В.Прохорова. — М.: Большая российская энциклопедия, 2003. — 912 с.

- Кобзарь А. И. Прикладная математическая статистика. Справочник для инженеров и научных работников. — М.: Физматлит, 2006. — 816 с.

Ссылки

- Statistical hypothesis testing — статья в англоязычной Википедии.

Тема 3.5.

СТАТИСТИЧЕСКИЕ ГИПОТЕЗЫ

План лекции:

-

Понятие гипотезы.

-

Схема статистической

проверки гипотезы.

Список литературы:

-

Вентцель, Е.С.

Теория вероятностей [Текст] / Е.С.

Вентцель. – М.: Высшая школа, 2006. – 575 с. -

Гмурман, В.Е. Теория

вероятностей и математическая статистика

[Текст] / В.Е. Гмурман. — М.: Высшая школа,

2007. — 480 с. -

Кремер, Н.Ш. Теория

вероятностей и математическая статистика

[Текст] / Н.Ш.

Кремер — М: ЮНИТИ, 2002. – 543 с.

п.1. Понятие

гипотезы.

Одна

из

часто

встречающихся на практике задач,

связанных с применением статистических

методов, состоит в решении вопроса о

том, должно ли на основании данной

выборки быть принято или, напротив,

отвергнуто некоторое предположение

(гипотеза) относительно генеральной

совокупности (случайной величины).

Например,

новое

лекарство испытано на определенном

числе людей. Можно ли сделать по

данным результатам лечения обоснованный

вывод о том, что новое лекарство более

эффективно, чем применявшиеся ранее

методы лечения? Аналогичный вопрос

логично задать, говоря о новом правиле

поступления в вуз, о новом методе

обучения, о пользе быстрой ходьбы, о

преимуществах новой модели автомобиля

или технологического процесса и т.

д.

Процедура

сопоставления высказанного предположения

(гипотезы) с выборочными данными

называется проверкой

гипотез.

Задачи

статистической проверки гипотез ставятся

в следующем виде: относительно некоторой

генеральной совокупности высказывается

та или иная гипотеза Н.

Из

этой генеральной совокупности извлекается

выборка. Требуется указать правило, при

помощи которого можно было бы по выборке

решить вопрос о том, следует ли

отклонить

гипотезу Н

или

принять

ее.

Следует

отметить, что статистическими методами

гипотезу можно

только опровергнуть или не опровергнуть,

но

не доказать. Например,

для

проверки утверждения (гипотеза Н)

автора,

что «в рукописи нет ошибок», рецензент

прочел (изучил)

несколько страниц рукописи.

Если

он обнаружил хотя бы одну ошибку, то

гипотеза Н

отвергается,

в противном случае — не отвергается,

говорят, что «результат проверки с

гипотезой согласуется».

Выдвинутая

гипотеза может быть правильной или

неправильной, поэтому возникает

необходимость ее проверки.

Под

статистической

гипотезой (или

просто гипотезой)

понимают

всякое высказывание (предположение) о

генеральной совокупности, проверяемое

по

выборке.

Статистические

гипотезы делятся на гипотезы о параметрах

распределения известного вида (это

так называемые параметрические

гипотезы)

и гипотезы о виде неизвестного

распределения (непараметрические

гипотезы).

Например,

статистическими являются гипотезы:

-

генеральная

совокупность распределена по закону

Пуассона; -

дисперсии

двух нормальных совокупностей равны

между собой.

В

первой гипотезе сделано предположение

о виде неизвестного распределения, во

второй – о параметрах двух известных

распределений.

Гипотеза

«на Марсе есть жизнь» не является

статистической, т.к. в ней не идёт речь

ни о виде, ни о параметрах распределения.

Наряду

с выдвинутой гипотезой рассматривают

и противоречащую ей гипотезу. Если

выдвинутая гипотеза будет отвергнута,

то имеет место противоречащая гипотеза.

Таким

образом, одну из гипотез выделяют в

качестве основной

(или

нулевой)

и

обозначают Но,

а другую, являющуюся логическим отрицанием

Н0,

т. е. противоположную Но

—

в качестве конкурирующей

(или

альтернативной)

гипотезы

и обозначают Н1.

Гипотезу,

однозначно фиксирующую распределение

наблюдений, называют простой

(в

ней идет речь об одном значении параметра),

в противном случае — сложной.

Например,

гипотеза Но,

состоящая

в том что математическое ожидание

случайной

величины

X

равно ао,

т.е. М(Х)=ао

является

простой. В качестве альтернативной

гипотезы можно рассматривать гипотезу

Н1:

М(Х)≠

ао

(сложная

гипотеза).

Имея

две гипотезы Но

и

Н1,

надо

на основе выборки Х1,…

,Хп

принять

либо основную гипотезу Н0,

либо

конкурирующую Н1.

Правило,

по которому принимается решение принять

или отклонить гипотезу Но

(соответственно,

отклонить или принять Н1),

называется

статистическим

критерием К (или

просто критерием)

проверки

гипотезы Но.

Проверку

гипотез осуществляют на основании

результатов выборки Х1,

Х2,…,

Хп,

из

которых формируют функцию выборки Кп

=К(Х1,

Х2,…,

Хn),

называемой статистикой

критерия.

Основной

принцип проверки гипотез состоит

в следующем. Множество возможных

значений статистики критерия Кп

разбивается

на два непересекающихся подмножества:

критическую

область S,

т.

е. область отклонения гипотезы Но

и

область

![]()

принятия

этой

гипотезы. Если фактически наблюдаемое

значение статистики критерия (т. е.

значение критерия, вычисленное по

выборке: Кнабл

=К(х1,х2,…,

хп))

попадает

в критическую область S,

то

основная гипотеза Но

отклоняется

и принимается альтернативная гипотеза

Н1;

если

же Кнабл

попадает

в

![]() ,

,

то

принимается Но,

а

Н1

отклоняется.

При

проверке гипотезы может быть принято

неправильное решение, т.

е. могут быть допущены ошибки двух родов:

Ошибка

первого рода состоит

в том, что отвергается нулевая гипотеза

Но,

когда

на самом деле она верна.

Ошибка

второго рода состоит

в том, что отвергается альтернативная

гипотеза Н1,

когда

она на самом деле верна.

Рассматриваемые

случаи наглядно иллюстрирует следующая

таблица.

|

Гипотеза |

Отвергается |

Принимается |

|

верна |

ошибка |

правильное |

|

неверна |

правильное |

ошибка |

Вероятность

ошибки 1-го рода (обозначается через α)

называется

уровнем

значимости критерия.

Очевидно,

α

= P(Н1Но).

Чем

меньше α,

тем

меньше вероятность отклонить верную

гипотезу. Допустимую ошибку 1-го рода

обычно задают заранее.

В

одних случаях считается возможным

пренебречь событиями, вероятность

которых меньше 0,05 (α=

0,05

означает, что в среднем в 5 случаях из

100 испытаний верная гипотеза будет

отвергнута), в других случаях, когда

речь идет, например, о разрушении

сооружений, гибели судна и т. п., нельзя

пренебречь обстоятельствами, которые

могут появиться с вероятностью,

равной

0,001.

Обычно

для α

используются

стандартные значения: α

= 0,05;

0,01; 0,005; 0,001.

Вероятность

ошибки 2-го рода обозначается через β,

т.е.

β

= Р(Н0Н1).

Величину

1- β,

т.

е. вероятность недопущения ошибки 2-го

рода (отвергнуть неверную гипотезу

принять верную Н1),

называется

мощностью

критерия.

Чем

больше мощность критерия, тем вероятность

ошибки 2-го рода меньше, что, конечно,

желательно (как и уменьшение α).

Последствия

ошибок 1-го, 2-го рода могут быть совершенно

различными: в одних случаях надо

минимизировать α,

в

другом — β.

Так,

применительно к производству, к торговле

можно сказать, что α

—

риск поставщика (т.е. забраковка по

выборке всей партии изделий, удовлетворяющих

стандарту), β — риск потребителя (т.е.

прием по выборке всей партии изделий,

не удовлетворяющей стандарту);

применительно к судебной системе, ошибка

1-го рода приводит к оправданию виновного,

ошибка 2-го рода — осуждению невиновного.

Или, например, если отвергнуто правильное

решение «продолжить строительство

жилого дома», то эта ошибка первого рода

повлечёт материальный ущерб; если же

принято неправильное решение «продолжать

строительство», несмотря на опасность

обвала стройки, то эта ошибка второго

рода может повлечь гибель людей.

Отметим,

что одновременное

уменьшение ошибок 1-го

и 2-го рода возможно лишь при увеличении

объема выборок. Поэтому

обычно при заданном уровне значимости

α

отыскивается

критерий с наибольшей мощностью.

п.2. Схема

статистической проверки гипотезы.

Методика

проверки гипотез сводится к следующему:

-

Располагая

выборкой Х1,

Х2,…,Хп,

формируют

нулевую гипотезу Но

и

альтернативную Н1. -

В

каждом конкретном случае подбирают

статистику критерия Кп=К(Х1,Х2,…,

Хп). -

По

статистике критерия Кп

и

уровню значимости а

определяют

критическую область S

(и ).

).

Для

ее отыскания достаточно найти критическую

точку kкр,

т.е. границу (или квантиль), отделяющую

область S

от .

.

Границы

областей определяются, соответственно,

из соотношений: Р(Kп

>

kкр)

= а,

для

правосторонней критической области S;

Р(Kп

<kкр)

= а,

для

левосторонней критической области

S;

Р(Kп

<

![]() )

)

= Р(Kп

>

![]() )

)

=![]() ,

,

для двусторонней критической области

S.

Для

каждого критерия имеются соответствующие

таблицы, по которым и находят

критическую точку, удовлетворяющую

приведенным выше соотношениям.

-

Для

полученной реализации выборки

подсчитывают значение критерия, т.е.

Кнабл

=К(х1,х2,…,

хп)=

k. -

Если

(например,

для правосторонней области S),

то нулевую гипотезу Н0

отвергают, если же

( ),

),

то нет оснований, чтобы отвергнуть

гипотезу Но.

Во

многих случаях закон распределения

изучаемой случайно величины неизвестен,

но есть основания предположить, что он

имеет вполне определенный вид: нормальный,

биномиальный или какой-либо другой.

Пусть

необходимо проверить гипотезу Но

о

том, что случайная

величина

X

подчиняется

определенному закону распределения,

заданному функцией распределения Fо(х),

т.

е. Но:

Fх(х)=Fо(х).

Под

альтернативной гипотезой Н1

будем

понимать в данном случае то, что просто

не выполнена основная (т.е. Н1:

Fх(х)≠

Fо(х)).

Для

проверки гипотезы о распределении

случайной величины X

проведем

выборку, которую оформим в виде

статистического ряда:

|

xi |

x1 |

x2 |

… |

Xm |

|

ni |

n1 |

n2 |

… |

nm |

где

![]()

—

объем выборки.

Требуется

сделать заключение: согласуются ли

результаты наблюдений с высказанным

предположением. Для этого используем

специально подобранную величину —

критерий согласия.

Критерием

согласия называют

статистический критерий проверки

гипотезы о предполагаемом законе

неизвестного распределения. (Он

используется для проверки согласия

предполагаемого вида распределения

с опытными данными на основании выборки.)

Существуют

различные критерии согласия: Пирсона,

Колмогорова, Фишера, Смирнова и др.

Критерий согласия Пирсона — наиболее

часто употребляемый критерий для

проверки простой гипотезы о законе

распределения.

Рассмотрим

применение критерия согласия Пирсона

для проверки гипотезы о нормальном

распределении исследуемой случайной

величины X.

По

результатам выборки подсчитывают:

![]()

— эмпирическую абсолютную частоту для

каждого варианта;

![]() —

—

оценку математического ожидания;

![]()

— несмещённую оценку среднего

квардатического отклонения; числа

![]()

в предположении нормальности случайной

величины X

с параметрами

![]() ,

,

![]() ;

;

числа

![]()

— теоретические частоты, где n

– объем выборки.

В

качестве критерия проверки нулевой

гипотезы примем случайную величину

![]() .

.

Доказано, что при

![]()

закон распределения этой случайной

величины, независимо от закона

распределения изучаемой величины X,

стремиться к известному закону

![]()

с f

степенями

свободы. Число f

находят из равенства

![]() ,

,

где i

– число частичных интервалов, r

– число параметров предполагаемого

распределения. В случае нормального

закона r=2.

Построим

правостороннюю критическую область,

исходя из требования, что вероятность

попадания критерия в эту область, в

предположении справедливости нулевой

гипотезы, была равна принятому уровню

значимости α:

![]() .

.

Точка

![]()

по данным f

и α находится по таблице критических

точек распределения

![]() .

.

На основании выборки вычисляем

![]() .

.

Если

![]() ,

,

то нулевую гипотезу отвергают, в противном

случае её можно принять.

5

5.3. Ошибки первого и второго рода

Ошибка первого рода состоит в том, что гипотеза ![]() будет отвергнута, хотя на самом деле она правильная. Вероятность

будет отвергнута, хотя на самом деле она правильная. Вероятность

допустить такую ошибку называют уровнем значимости и обозначают буквой ![]() («альфа»).

(«альфа»).

Ошибка второго рода состоит в том, что гипотеза ![]() будет принята, но на самом деле она неправильная. Вероятность

будет принята, но на самом деле она неправильная. Вероятность

совершить эту ошибку обозначают буквой ![]() («бета»). Значение

(«бета»). Значение ![]() называют мощностью критерия – это вероятность отвержения неправильной

называют мощностью критерия – это вероятность отвержения неправильной

гипотезы.

В практических задачах, как правило, задают уровень значимости, наиболее часто выбирают значения ![]() .

.

И тут возникает мысль, что чем меньше «альфа», тем вроде бы лучше. Но это только вроде: при уменьшении

вероятности ![]() —

—

отвергнуть правильную гипотезу растёт вероятность ![]() — принять неверную гипотезу (при прочих равных условиях).

— принять неверную гипотезу (при прочих равных условиях).

Поэтому перед исследователем стоит задача грамотно подобрать соотношение вероятностей ![]() и

и ![]() , при этом учитывается тяжесть последствий, которые

, при этом учитывается тяжесть последствий, которые

повлекут за собой та и другая ошибки.

Понятие ошибок 1-го и 2-го рода используется не только в статистике, и для лучшего понимания я приведу пару

нестатистических примеров.

Петя зарегистрировался в почтовике. По умолчанию, ![]() – он считается добропорядочным пользователем. Так считает антиспам

– он считается добропорядочным пользователем. Так считает антиспам

фильтр. И вот Петя отправляет письмо. В большинстве случаев всё произойдёт, как должно произойти – нормальное письмо дойдёт до

адресата (правильное принятие нулевой гипотезы), а спамное – попадёт в спам (правильное отвержение). Однако фильтр может

совершить ошибку двух типов:

1) с вероятностью ![]() ошибочно отклонить нулевую гипотезу (счесть нормальное письмо

ошибочно отклонить нулевую гипотезу (счесть нормальное письмо

за спам и Петю за спаммера) или

2) с вероятностью ![]() ошибочно принять нулевую гипотезу (хотя Петя редиска).

ошибочно принять нулевую гипотезу (хотя Петя редиска).

Какая ошибка более «тяжелая»? Петино письмо может быть ОЧЕНЬ важным для адресата, и поэтому при настройке фильтра

целесообразно уменьшить уровень значимости ![]() , «пожертвовав» вероятностью

, «пожертвовав» вероятностью ![]() (увеличив её). В результате в основной ящик будут попадать все

(увеличив её). В результате в основной ящик будут попадать все

«подозрительные» письма, в том числе особо талантливых спаммеров. …Такое и почитать даже можно, ведь сделано с любовью

Существует примеры, где наоборот – более тяжкие последствия влечёт ошибка 2-го рода, и вероятность ![]() следует увеличить (в пользу уменьшения

следует увеличить (в пользу уменьшения

вероятности ![]() ). Не хотел я

). Не хотел я

приводить подобные примеры, и даже отшутился на сайте, но по какой-то мистике через пару месяцев сам столкнулся с непростой

дилеммой. Видимо, таки, надо рассказать:

У человека появилась серьёзная болячка. В медицинской практике её принято лечить (основное «нулевое» решение). Лечение

достаточно эффективно, однако не гарантирует результата и более того опасно (иногда приводит к серьёзному пожизненному

увечью). С другой стороны, если не лечить, то возможны осложнения и долговременные функциональные нарушения.

Вопрос: что делать? И ответ не так-то прост – в разных ситуациях разные люди могут принять разные

решения (упаси вас).

Если болезнь не особо «мешает жить», то более тяжёлые последствия повлечёт ошибка 2-го рода – когда человек соглашается

на лечение, но получает фатальный результат (принимает, как оказалось, неверное «нулевое» решение). Если же…, нет, пожалуй,

достаточно, возвращаемся к теме:

5.4. Процесс проверки статистической гипотезы

5.4. Процесс проверки статистической гипотезы

5.2. Нулевая и альтернативная гипотезы

5.2. Нулевая и альтернативная гипотезы

| Оглавление |

Ошибки, встроенные в систему: их роль в статистике

Время на прочтение

6 мин

Количество просмотров 13K

В прошлой статье я указал, как распространена проблема неправильного использования t-критерия в научных публикациях (и это возможно сделать только благодаря их открытости, а какой трэш творится при его использовании во всяких курсовых, отчетах, обучающих задачах и т.д. — неизвестно). Чтобы обсудить это, я рассказал об основах дисперсионного анализа и задаваемом самим исследователем уровне значимости α. Но для полного понимания всей картины статистического анализа необходимо подчеркнуть ряд важных вещей. И самая основная из них — понятие ошибки.

Ошибка и некорректное применение: в чем разница?

В любой физической системе содержится какая-либо ошибка, неточность. В самой разнообразной форме: так называемый допуск — отличие в размерах разных однотипных изделий; нелинейная характеристика — когда прибор или метод измеряют что-то по строго известному закону в определенных пределах, а дальше становятся неприменимыми; дискретность — когда мы чисто технически не можем обеспечить плавность выходной характеристики.

И в то же время существует чисто человеческая ошибка — некорректное использование устройств, приборов, математических законов. Между ошибкой, присущей системе, и ошибкой применения этой системы есть принципиальная разница. Важно различать и не путать между собой эти два понятия, называемые одним и тем же словом «ошибка». Я в данной статье предпочитаю использовать слово «ошибка» для обозначения свойства системы, а «некорректное применение» — для ошибочного ее использования.

То есть, ошибка линейки равна допуску оборудования, наносящего штрихи на ее полотно. А ошибкой в смысле некорректного применения было бы использовать ее при измерении деталей наручных часов. Ошибка безмена написана на нем и составляет что-то около 50 граммов, а неправильным использованием безмена было бы взвешивание на нем мешка в 25 кг, который растягивает пружину из области закона Гука в область пластических деформаций. Ошибка атомно-силового микроскопа происходит из его дискретности — нельзя «пощупать» его зондом предметы мельче, чем диаметром в один атом. Но способов неправильно использовать его или неправильно интерпретировать данные существует множество. И так далее.

Так, а что же за ошибка имеет место в статистических методах? А этой ошибкой как раз и является пресловутый уровень значимости α.

Ошибки первого и второго рода

Ошибкой в математическом аппарате статистики является сама ее Байесовская вероятностная сущность. В прошлой статье я уже упоминал, на чем стоят статистические методы: определение уровня значимости α как наибольшей допустимой вероятности неправомерно отвергнуть нулевую гипотезу, и самостоятельное задание исследователем этой величины перед исследователем.

Вы уже видите эту условность? На самом деле, в критериальных методах нету привычной математической строгости. Математика здесь оперирует вероятностными характеристиками.

И тут наступает еще один момент, где возможна неправильная трактовка одного слова в разном контексте. Необходимо различать само понятие вероятности и фактическую реализацию события, выражающуюся в распределении вероятности. Например, перед началом любого нашего эксперимента мы не знаем, какую именно величину мы получим в результате. Есть два возможных исхода: загадав некоторое значение результата, мы либо действительно его получим, либо не получим. Логично, что вероятность и того, и другого события равна 1/2. Но показанная в предыдущей статье Гауссова кривая показывает распределение вероятности того, что мы правильно угадаем совпадение.

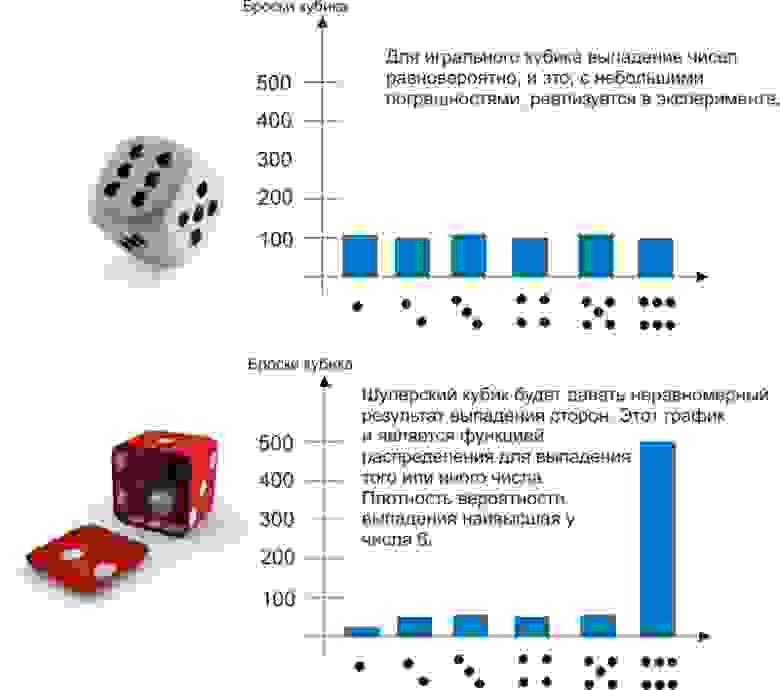

Наглядно можно проиллюстрировать это примером. Пусть мы 600 раз бросаем два игральных кубика — обычный и шулерский. Получим следующие результаты:

До эксперимента для обоих кубиков выпадение любой грани будет равновероятно — 1/6. Однако после эксперимента проявляется сущность шулерского кубика, и мы можем сказать, что плотность вероятности выпадения на нем шестерки — 90%.

Другой пример, который знают химики, физики и все, кто интересуется квантовыми эффектами — атомные орбитали. Теоретически электрон может быть «размазан» в пространстве и находиться практически где угодно. Но на практике есть области, где он будет находиться в 90 и более процентах случаев. Эти области пространства, образованные поверхностью с плотностью вероятности нахождения там электрона 90%, и есть классические атомные орбитали, в виде сфер, гантелей и т.д.

Так вот, самостоятельно задавая уровень значимости, мы заведомо соглашаемся на описанную в его названии ошибку. Из-за этого ни один результат нельзя считать «стопроцентно достоверным» — всегда наши статистические выводы будут содержать некоторую вероятность сбоя.

Ошибка, формулируемая определением уровня значимости α, называется ошибкой первого рода. Ее можно определить, как «ложная тревога», или, более корректно, ложноположительный результат. В самом деле, что означают слова «ошибочно отвергнуть нулевую гипотезу»? Это значит, по ошибке принять наблюдаемые данные за значимые различия двух групп. Поставить ложный диагноз о наличии болезни, поспешить явить миру новое открытие, которого на самом деле нет — вот примеры ошибок первого рода.

Но ведь тогда должны быть и ложноотрицательные результаты? Совершенно верно, и они называются ошибками второго рода. Примеры — не поставленный вовремя диагноз или же разочарование в результате исследования, хотя на самом деле в нем есть важные данные. Ошибки второго рода обозначаются буквой, как ни странно, β. Но само это понятие не так важно для статистики, как число 1-β. Число 1-β называется мощностью критерия, и как нетрудно догадаться, оно характеризует способность критерия не упустить значимое событие.

Однако содержание в статистических методах ошибок первого и второго рода не является только лишь их ограничением. Само понятие этих ошибок может использоваться непосредственным образом в статистическом анализе. Как?

ROC-анализ

ROC-анализ (от receiver operating characteristic, рабочая характеристика приёмника) — это метод количественного определения применимости некоторого признака к бинарной классификации объектов. Говоря проще, мы можем придумать некоторый способ, как отличить больных людей от здоровых, кошек от собак, черное от белого, а затем проверить правомерность такого способа. Давайте снова обратимся к примеру.

Пусть вы — подающий надежды криминалист, и разрабатываете новый способ скрытно и однозначно определять, является ли человек преступником. Вы придумали количественный признак: оценивать преступные наклонности людей по частоте прослушивания ими Михаила Круга. Но будет ли давать адекватные результаты ваш признак? Давайте разбираться.

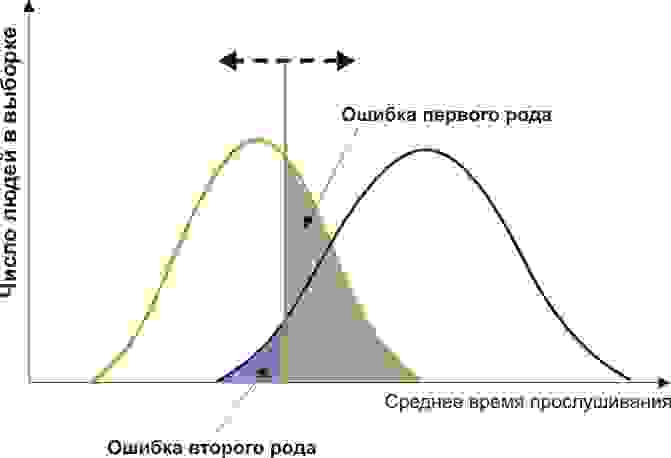

Вам понадобится две группы людей для валидации вашего критерия: обычные граждане и преступники. Положим, действительно, среднегодовое время прослушивания ими Михаила Круга различается (см. рисунок):

Здесь мы видим, что по количественному признаку времени прослушивания наши выборки пересекаются. Кто-то слушает Круга спонтанно по радио, не совершая преступлений, а кто-то нарушает закон, слушая другую музыку или даже будучи глухим. Какие у нас есть граничные условия? ROC-анализ вводит понятия селективности (чувствительности) и специфичности. Чувствительность определяется как способность выявлять все-все интересующие нас точки (в данном примере — преступников), а специфичность — не захватывать ничего ложноположительного (не ставить под подозрение простых обывателей). Мы можем задать некоторую критическую количественную черту, отделяющую одних от других (оранжевая), в пределах от максимальной чувствительности (зеленая) до максимальной специфичности (красная).

Посмотрим на следующую схему:

Смещая значение нашего признака, мы меняем соотношения ложноположительного и ложноотрицательного результатов (площади под кривыми). Точно так же мы можем дать определения Чувствительность = Полож. рез-т/(Полож. рез-т + ложноотриц. рез-т) и Специфичность = Отриц. рез-т/(Отриц. рез-т + ложноположит. рез-т).

Но главное, мы можем оценить соотношение положительных результатов к ложноположительным на всем отрезке значений нашего количественного признака, что и есть наша искомая ROC-кривая (см. рисунок):

А как нам понять из этого графика, насколько хорош наш признак? Очень просто, посчитать площадь под кривой (AUC, area under curve). Пунктирная линия (0,0; 1,1) означает полное совпадение двух выборок и совершенно бессмысленный критерий (площадь под кривой равна 0,5 от всего квадрата). А вот выпуклость ROC кривой как раз и говорит о совершенстве критерия. Если же нам удастся найти такой критерий, что выборки вообще не будут пересекаться, то площадь под кривой займет весь график. В целом же признак считается хорошим, позволяющим надежно отделить одну выборку от другой, если AUC > 0,75-0,8.

С помощью такого анализа вы можете решать самые разные задачи. Решив, что слишком много домохозяек оказались под подозрением из-за Михаила Круга, а кроме того упущены опасные рецидивисты, слушающие Ноггано, вы можете отвергнуть этот критерий и разработать другой.

Возникнув, как способ обработки радиосигналов и идентификации «свой-чужой» после атаки на Перл-Харбор (отсюда и пошло такое странное название про характеристику приемника), ROC-анализ нашел широкое применение в биомедицинской статистике для анализа, валидации, создания и характеристики панелей биомаркеров и т.д. Он гибок в использовании, если оно основано на грамотной логике. Например, вы можете разработать показания для медицинской диспансеризации пенсионеров-сердечников, применив высокоспецифичный критерий, повысив эффективность выявления болезней сердца и не перегружая врачей лишними пациентами. А во время опасной эпидемии ранее неизвестного вируса вы наоборот, можете придумать высокоселективный критерий, чтобы от вакцинации в прямом смысле не ускользнул ни один чих.

С ошибками обоих родов и их наглядностью в описании валидируемых критериев мы познакомились. Теперь же, двигаясь от этих логических основ, можно разрушить ряд ложных стереотипных описаний результатов. Некоторые неправильные формулировки захватывают наши умы, часто путаясь своими схожими словами и понятиями, а также из-за очень малого внимания, уделяемого неверной интерпретации. Об этом, пожалуй, нужно будет написать отдельно.