Ахмеджанов Ф.М. Akhmedzhanov F.M.

кандидат технических наук,

Крымский В.Г. Krymsky УМ.

доктор технических наук, профессор кафедры «Управление и сервис в технических системах», ФГБОУ ВО «Уфимский государственный нефтяной технический университет», г. Уфа, Российская Федерация

доцент кафедры «Управление и сервис в технических системах», ФГБОУ ВО «Уфимский государственный нефтяной

технический университет», г. Уфа, Российская Федерация

УДК 519.873:007.5

DOI: 10.17122/1999-5458-2019-15-1-60-69

АЛГОРИТМ ОЦЕНКИ НАДЕЖНОСТИ ЧЕЛОВЕКА-ОПЕРАТОРА НА ОСНОВЕ МОДИФИЦИРОВАННОЙ МЕТОДИКИ HEART

Методика HEART (human error assessment and reduction technique) относится к числу наиболее простых и удобных инструментов для оценки надежности человека-оператора, действующего в составе сложных технологических систем. В то же время в традиционной версии эта методика обладает рядом недостатков. В частности, она не учитывает время до возникновения ошибки (т.е. время до отказа), а также требует задания фиксированных значений для номинальных вероятностей ошибок, связанных с человеческим фактором.

В статье предлагается новая модификация методики HEART, которая имеет целью преодолеть эти препятствия. Она основана на использовании аппарата интервальных вероятностей и привлечении экспертных суждений для того, чтобы сделать модель более адекватной реальным условиям.

Применение предложенного алгоритма иллюстрируется численными примерами.

Ключевые слова: надежность человека-оператора, методика HEART, интервальнознач-ные вероятности.

ALGORITHM FOR ASSESSMENT OF HUMAN OPERATOR RELIABILITY BASED ON MODIFIED HEART METHODOLOGY

AbstractThe methodology named HEART (human error assessment and reduction technique) is one of the simplest and most convenient tools for assessing the reliability of a human operator acting as a part of complex technological systems. At the same time, in the traditional version, this technique has several disadvantages. In particular, it does not take into account the time before the occurrence of the error (i.e. time to failure), and also requires the assignment of fixed values for the nominal error probabilities associated with the human factor.

The paper proposes the new modification of HEART methodology which aims at overcoming these obstacles. It is based on the use of the interval probabilities technique and the involvement of expert judgments in order to make the model more adequate to real conditions.

The application of the proposed algorithm is illustrated by numerical examples.

Key words: human reliability, HEART methodology, interval-valued probabilities

Введение

В число подходов к оцениванию влияния человеческого фактора на надежность сложных технологических систем, которые включены в перечень методов HRA (т.е. «Human Reliability Analysis», или «Анализ надежности человека») стандарта ГОСТ Р МЭК 62508-2014 «Менеджмент риска. Анализ влияния на надежность человеческого фактора», входит так называемый метод HEART. Эта аббревиатура расшифровывается как «human error assessment and reduction technique», или инструментарий для оценивания и сокращения количества человеческих ошибок. Указанный метод был впервые представлен в 1985 г. в публикации Дж. Виллиамса [1] и позднее, пройдя через некоторые корректировки, получил широкое распространение на практике. Метод предполагает выполнение ряда последовательных шагов [2]:

1) конкретизация анализируемой деятельности человека в составе сложной системы;

2) соотнесение задач, стоящих в процессе данной деятельности перед человеком, с позициями предлагаемого списка обобщенных задач и установлением номинальных вероятностей GEP человеческой ошибки (отказа) (табл. 1);

3) идентификация условий, приводящих к ошибке человека в процессе рассматриваемой деятельности (задание весовых коэффициентов W(i), позволяющих учесть i-е соче-

Таблица1

тание этих условий, осуществляется с помощью выбора значения в соответствующей строке таблицы 2);

4) оценивание интенсивности проявления этих условий (оно находит отражение в «распределении» величин коэффициентов важности R(i) между сочетаниями условий, что делается, как правило, экспертным путем);

5) вычисление окончательного значения вероятности ошибки человека-оператора согласно выражению

где п — общее число вариантов условий, приводящих к ошибкам при реализации человеком рассматриваемой деятельности;

В монографии [3] приводится наглядный пример, иллюстрирующий применение этой методики. Автор рассматривает действия оператора по замене в химико-технологической установке старого клапана из-за его отказа на новый. Сначала оператор выключает из функционирования линию, в которой произошел отказ клапана, затем ремонтник заменяет неисправный клапан новым. После этого линия начинает работать с замененным клапаном.

Обозначение обобщенной задачи Характеристика задачи Номинальная вероятность ошибки GEP Интервал между квантилями для уровней 5 % и 95 % применительно к логнормальному распределению

А Полностью незнакомая задача, которую необходимо выполнять быстро и при отсутствии реального представления о последствиях 0,55 (0,35-0,97)

B Перевод системы в новое состояние или восстановление ее оригинального состояния за одну попытку без руководства и инструкций 0,26 (0,14-0,42)

C Сложная задача, требующая высокого уровня понимания и практических навыков 0,16 (0,12 — 0,28)

D Достаточно простая задача, выполняемая быстро или требующая ограниченного внимания 0,09 (0,06 — 0,13)

E Обычная, в высокой степени практическая задача, для которой необходим относительно низкий уровень квалификации 0,02 (0,07 — 0,045)

F Восстановление либо перевод системы в оригинальное или новое состояние в соответствии с установленными процедурами и с некоторой проверкой 0,003 (0,0008 — 0,007)

G Полностью знакомая, хорошо сформулированная, в высокой степени практическая задача, возникающая несколько раз в день и выполняемая согласно наилучшим из возможных стандартов высокомотивированным, хорошо обученным и опытным персоналом, при наличии времени для исправления потенциальной ошибки, но без значительной помощи в работе 0,0004 (0,00008 — 0,009)

н Правильное реагирование на системную команду, в том числе при наличии расширенной или автоматизированной системы контроля, обеспечивающей точную интерпретацию системного состояния 0,00002 (0,000006 — 0,00009)

м Прочие задачи, для которых нельзя найти какое-либо описание 0,003 (0,008 — 0,11)

Таблица 2

Условия, приводящие к возникновению ошибки Вес

1 Неизвестная ситуация, потенциально важная, но случающаяся нечасто или впервые 17

2 Дефицит времени для определения и коррекции ошибки 11

3 Низкое отношение уровней сигнал — шум 10

4 Средства подавления или аннулирования информации либо ее аспектов, которые слишком легкодоступны 9

5 Отсутствие способов передачи пространственной или функциональной информации операторам в форме, которую они готовы воспринимать 8

6 Несоответствие между моделью предметной области оператора и представлением разработчика 8

7 Отсутствие очевидных способов отмены непреднамеренных действий 8

8 Перегрузка канала, в частности, вызванная одновременным представлением различной неизбыточной информации 6

9 Необходимость забыть привычную методику и применить другую, основанную на альтернативных подходах 6

10 Необходимость передавать определенные знания от задания к заданию без потерь 5,5

11 Неопределенность в нормах выработки, фигурирующих в требованиях 5

12 Несоответствие между воспринимаемым и реальным риском 4

13 Слабая, неопределенная или неструктурированная системная обратная связь 4

14 Нет ясных, прямых и своевременных подтверждений намеченных действий со стороны той части системы, по отношению к которой осуществляется управление 3

15 Неопытный оператор (например, только что получивший квалификацию, не «эксперт») 3

16 Низкое качество информации, поступающей по итогам процедур и от человека человеку 3

— 63

Электротехнические и информационные комплексы и системы. № 1, т. 15, 2019

17 Малая или не вполне независимая проверка (тестирование) результатов 3

18 Конфликт между тактическими и стратегическими целями 2,5

19 Нет разнообразия источников информации для проверки достоверности 2,5

20 Несоответствие уровня обучения персонала требованиям задания 2

21 Побуждение использовать другие, более опасные процедуры 2

22 Небольшие возможности для упражнений ума и тела за рамками непосредственного выполнения работы 1,8

23 Ненадежные измерительные приборы (достаточно подозрений по этому поводу) 1,6

24 Необходимость оценок, лежащих за пределами компетентности или опыта оператора 1,6

25 Неясное распределение функций и обязанностей 1,6

26 Отсутствие очевидных способов удерживать процесс в требуемых пределах 1,4

27 Опасность превышения предельных физических возможностей 1,4

28 Малый или несущественный смысл задания 1,4

29 Высокий уровень эмоционального стресса 1,3

30 Свидетельство нездоровья работника, особенно наличие лихорадки 1,2

31 Низкий уровень моральных побуждений к труду 1,2

32 Несогласованность того, как представляется процесс и его значимости 1,2

33 Плохая окружающая среда (качество ниже 75 % от того, которое требуется для отсутствия угрозы жизни или здоровью) 1,15

34 Длительное бездействие или часто повторяющиеся циклы задач, 1,1 (для пер-

ориентированные на низкий уровень интеллектуальной загрузки вого получаса работы) 1,05 (для остальных часов)

35 Недосыпание 1,1

36 Сбой рабочего ритма, вызванный вмешательством посторонних 1,06

37 Члены команды — недостающие или лишние 1,03 на каждого

38 Возраст персонала, выполняющего работу 1,02

Анализируется случай, когда оператор имеет опыт выполнения таких заданий, а ремонтник — нет. В результате через 10 минут после начала работы отремонтированной системы зафиксирована утечка, вызванная ошибкой в процессе установки нового клапана.

Замена контрольного клапана включает в себя пять шагов:

1. Проверить, выведена ли линия с клапаном для ремонта из эксплуатации.

2. Проверить и убедиться, что на линии, где находится требующий ремонта клапан, отсутствует давление.

3. Изолировать линии, ведущие к клапану.

4. Заменить неисправный клапан новым.

5. Ввести линию с новым клапаном в действие.

Применение методологии HEART начинается с того, что для каждого из этих пяти шагов необходимо подобрать соответствие ситуации позициям таблицы 1. Шаги 1, 2, 3 и

5 выполняются опытным оператором, следовательно, соответствуют ситуации, обозначенной H, и номинальная вероятность человеческой ошибки будет равна 0,00002. Шаг 4 вследствие того, что ремонтник не обладает необходимым опытом, соответствует ситуации B, и для данного случая такая вероятность будет равна 0,26.

Шаги 1, 2, 3, 5 связаны только с одним условием из таблицы 2, которое способно вызвать ошибку, а именно: «дефицит времени для определения и коррекции ошибки». Оно характеризуется весом W(i), равным 11. Так как условие единственное, то R(i) при i = 1 равно единице.

Применение формулы (1) к этим данным даст следующий результат:

HEP=0,00002*(1*(11-1)+1)=0,00022.

Для перечисленных выше шагов в сумме НЕР составляет 0,00022*4=0,00088.

Для действия в рамках шага 4 можно указать два таких «опасных» условия:

— «неопытность оператора», вес которого равен 3, а интенсивность R(i) проявления которого по данным экспертного оценивания составляет 0,7;

— «высокий уровень эмоционального стресса», вес которого равен 1,3, а интенсивность проявления равна 1 — 0,7 = 0,3. Итоговая вероятность человеческой ошибки для шага 4 будет равна:

HEP=0,26*(0,7*(3-1)+1)*(0,3*(1,3-1)+1)=0,68016.

Результирующее значение вероятности ошибки человека-оператора, равное сумме вычисленных значений вероятностей для каждого шага, составляет 0,68104. Очевидно, что решающий вклад в это значение дает четвертый шаг, выполняемый неопытным ремонтником.

Следует отметить, что при полностью независимом задании величин GEP, W(i) и R(i) значение вероятности HEP может оказаться больше единицы. К этому выводу нетрудно прийти, наложив необходимое требование на правую часть выражения (1) в случае, если п = 1:

iНе можете найти то, что вам нужно? Попробуйте сервис подбора литературы.

GEP (Щ) (Щг)-1) +1) < 1. (3)

Отсюда

Тогда если GEP = 0,12 (ситуация С, табл. 1) и W(i) = 11 (строка 2 в табл. 2), то неравенство (4) приобретает вид:

Но согласно (2) при n = 1 должно выполняться R(i) = 1, что сразу же приводит к получению вероятностей HEP, больших единицы.

Авторы методики не дают ответа, как поступать в подобных случаях. Очевидно, если вычисляемое значение вероятности оказывается больше единицы, то принимается НЕР=1.

Из приведенного рассмотрения видны сильные стороны методологии HEART. К ним необходимо отнести «прозрачность» ее применения — практически любой набор действий можно «разобрать» на составляющие и увидеть, какой вклад вносит каждый исполняемый шаг в результирующее значение вероятности человеческой ошибки. Из такого анализа напрямую вытекают меры, которые необходимо предпринять для того, чтобы снизить значение этой вероятности до приемлемых величин.

Между тем, рассматриваемая методология имеет и ряд недостатков. В частности, они касаются выбора величины номинальной вероятности GEP человеческой ошибки и заключаются в следующем:

а) принимается, что такие вероятности для любых видов деятельности соответствуют определенному (логнормальному) закону распределения (табл. 1), что на практике сложно, а зачастую — невозможно обосновать;

б) в традиционной модели, вытекающей из методики HEART, совершенно игнорируется фактор времени; между тем ясно, что вероятности GEP меняются с течением времени t, т.е. GEP = GEP(t).

Ниже предлагается новая версия алгоритма, реализующего методику HEART, при создании которой поставлена цель повышения адекватности модели реальным условиям деятельности человека-оператора и устранения перечисленных недостатков.

Новая модификация методики heart на базе моделей, относящихся к теории интер-вальнозначных вероятностей

Будем далее исходить из предпосылок, которые, на наш взгляд, в значительно большей степени характерны для практики, чем те, которые отражены в таблице 1, а именно:

1) номинальные вероятности GEP ошибок человека для обобщенных задач A, B, C, …, H рассматриваются как функции времени t;

2) величины этих вероятностей не берутся в фиксированном виде из таблицы 1, а оцениваются по накопленной статистике либо называются экспертом, причем и в том, и в другом случае они соответствуют определенному интервалу времени [0, t*) (т.е. принимается, что известны значения GEP(t*));

3) вид закона распределения указанных вероятностей полагается неизвестным, что вытекает из реально имеющегося уровня неопределенности.

Определим номинальную вероятность GEP (t) человеческой ошибки на интервале [0, tfac). Здесь tfact — время, в течение которого человек фактически работает в рамках выбранной обобщенной задачи из списка A, B, C, …, H. Высокий уровень неопределенности приводит к тому, что значение GEP(tfaa,) в данном случае оказывается возможным оценить только с точностью до содержащего его интервала с границами GEP {С),

При этом должны соблюдаться ограничения:

где f(t) — неизвестная плотность распределения времени до ошибки человека-оператора, Т* — максимальное время его работы в рамках выбранной обобщенной задачи, / (/) —

индикаторная функция, равная 1 при t< t* либо равная 0 в противном случае.

В свою очередь,

Мы можем рассматривать (8) как оптимизируемый функционал, стремясь найти

с учетом ограничений (6), (7).

Поставленная задача принадлежит классу задач определения так называемых «интервальных», или «неточных» («imprecise»), вероятностей, в отношении которых основополагающими работами принято считать монографии [4, 5].

Между тем, в работе [6] показано, что при ограничениях вида (6), (7) (изопериметриче-ских, т.е. сформулированных применительно лишь к интегралам от выражений, включающих f(t)), решения этой оптимизационной задачи представляют собой линейные комбинации 5-функций. Подобные плотности распределения характеризуют сосредоточение «вероятностной массы» в дискретной совокупности точек, что не соответствует реальным процессам, для описания которых используются формируемые вероятностные модели.

Для преодоления вышеназванной трудности в постановку задачи целесообразно ввести также голономные ограничения, касающиеся выражений, которые зависят непосредственно от f(t)). Соответствующие подходы предложены и исследованы в публикациях [7-12]. В работе [13] показана эффективность применения для оценки надежности человека-оператора голономного ограничения вида

т<к, (ю)

где K — заданное положительное число.

В данном случае воспользуемся идеей, описанной в работах [10, 11], и введем ограничения снизу ( Д ) и сверху ( д ) на величину интенсивности отказов (ошибок) человека X(t)

При этом значения Ди Я должны не противоречить неравенствам

1 — ехр(-Л/) < СЕР(Г*) < 1 — ехр(-1/). (12)

Преимущества такого подхода заключаются в том, что:

а) ограничения на величину 1(1), как правило, относительно несложно получить по результатам экспертного опроса либо из статистики, накопленной по аналогичным системам с участием человека;

б) как показано в [10, 11], при наличии в постановке оптимизационной задачи неравенств вида (11) возможно рассмотрение случая Т*^-<х> (так называемый «бесконечный горизонт управления» [14]), что позволяет устранить необходимость эвристического задания величины Т*, которая обычно не известна.

Поставим целью определение &ЕР^Гас1) и

ОЕР^ш)в предположении, что ¡^>1*.

Такого рода задача решена в примере 1 статьи [12]. Воспользовавшись этим решением, можно записать, что

= 1-(1-С^))ехР(-%сг — О). (14)

Покажем, как «работают» соотношения (12), (13) на численных данных. Пусть 1* = 4 часа, 1 = 8 часов, GEP(t*) = 0,26 (аналогично ситуации, характеризуемой обобщенной задачей В, табл. 1), Я = 0,06 (1/час),

Я = 0,08 (1/час). Тогда из (13), (14) находим

Полученный интервал значений номинальной вероятности ошибки человека-оператора за время 8 часов отражает реальную неопределенность, в условиях которой осуществляется оценивание. Между тем для ответственных систем при планировании мер по предотвращению неблагоприятных событий целесообразно ориентироваться на наихудший случай, т.е. на величину верхней границы указанной вероятности.

Остановимся далее на случае ^<1*. Как показано в работах [11, 12], в такого рода ситуациях функция _Д1) = /*(1), на которой достигается максимум или минимум функционала (9) (т.е. экстремаль), является кусочно-непрерывной, причем на интервалах непрерывности она представляет собой экспоненту с параметром либо Я- Я, либо Л = Я.

При определении величины ОЕР^ /аа) последовательность интервалов непрерывности функции/*(1) соответствует рисунку 1.

Рисунок 1. Экстремаль при поиске ОЕР(1 / ;с1)

Момент времени переключения (рис. 1) , /^+1п(1 -СЕР«*)))/(Я-Л). (16) можно наити из соотношения — 1 V П

ехр(-^)ехр(-1(/*-0) = 1 -СЕР(П (15) Длд

или

заданных выше численных данных 1} = 0,945. Таким образом, если 1 <1 , то

а в противном случае

Если, например, tf / = 2 часа, то СЕР(^) =0,132.

Руководствуясь аналогичными соображениями и меняя при этом порядок следования интервалов непрерывности функции находим верхнюю границу искомой вероятности ошибки для £ = 2 часа:

моменту времени £ могут далее использоваться для расчета границ интервала результирующей вероятности НЕР(1/ас) в соответствии с формулой (1). При этом

Так, если tfact = 2 часа, GEP{tfact) = 0,132,

GEP(tfaa)

= 0,148.

Полученные таким образом величины нижней и верхней границы номинальной вероятности ошибки применительно к

Ш^,) = 0,132 * (0,7 * (3 — 1) + НЁРЦМ,) = ОД48 * (0,7 * (3 — 1) +

Интервал между двумя найденными значениями вероятности ошибки характеризует реальную неопределенность в исходной информации при постановке задачи. Для планирования управленческих решений целесообразно ориентироваться на наихудший случай, т.е. на верхнюю границу этой вероятности.

Вывод

Данная публикация продолжает изложение результатов исследований авторов в области усовершенствования методик оценки вероятностей неблагоприятных событий, связанных с человеческим фактором как ком-

= 0,148, (результат рассмотренного

выше примера), и необходимо оценить вероятность НЕР(1/ас)) для действий ремонтника на шаге 4 общей процедуры замены клапана (пример предыдущего раздела данной статьи), то

1) * (0,3 * (1,3 — 1) + 1) = 0,34531, 1) * (0,3 * (1,3 — 1) + 1) = 0,38717.

понентом сложных технологических систем. В ней анализируется известная методика HEART, которая, как и рассмотренная в предыдущей статье [13] методика SPAR-H, базируется на достаточно большом количестве не вполне обоснованных допущений.

Авторы показывают, что здесь, в частности, можно избежать необходимости в целом ряде допущений, если применить методы, разработанные в рамках теории интерваль-нозначных вероятностей. При этом подход становится более адекватным реальным условиям, не теряя своей простоты и наглядности.

Список литературы

1. Williams J.C. HEART — aproposed method for achieving high reliability in process operation by means of human factors engineering technology / J.C. Williams // Proceedings of a Symposium on the Achievement of Reliability in Operating Plant, Safety and Reliability Society (Southport, NC, the USA). — Elsevier, 1985. — P. 87-109.

2. Williams J.C. A data-based method for assessing and reducing human error to improveoperational performance // Proceedings of IEEE Fourth Conference on Human Factors in Power Plants (Monterey, CA, the USA). -IEEE Cat. No. 88CH2576-7. — 1988. — P. 436450.

3. Calixto E. Gas and Oil Reliability Engineering: Modeling and Analysis / E. Calixto // Waltham (the USA): Gulf Professional Publishing, 2013. — 545 p.

4. Walley P. Statistical Reasoning with Imprecise Probabilities / P. Walley. — London: Chapman and Hall, 1991. — 719 p.

5. Кузнецов В.П. Интервальные статистические модели / В.П. Кузнецов. — М.: Советское радио. — 1991. — 352 с.

6. Utkin L.V. Kozine I.O. Different Faces of the Natural Extension // Proceedings of the 2nd International Symposium on Imprecise Probabilities and Their Applications. -Maastricht: Shaker Publ., 2001. — P. 316-323.

7. Krymsky V.G. Computing Interval Bounds for Statistical Characteristics Under Expert-Provided Bounds on Probability Density Functions // Lecture Notes in Computer Science.

— 2006. — Vol. 3732. — P. 151-160.

8. Kozine I.O. Krymsky V.G. Computing Interval-Valued Statistical Characteristics: What is the Stumbling Block for Reliability Applications? // International Journal of General Systems. — Vol. 38. — No. 5. — 2009. — P. 547565.

9. Kozine I., Krymsky V.G. Bounded densities and their derivatives: extension to other domains // Journal of Statistical Theory and Practice. — Vol. 3. — No. 1. — 2009. — P. 25-38.

10. Kozine I., Krymsky V. An interval-valued reliability model with bounded failure rates // International Journal of General Systems.

— Vol. 41. — No. 8. — 2012. — P. 760-773.

11. Krymsky V.G. Control Theory Based Uncertainty Model in Reliability Applications // International Journal of Performability Engineering. — Vol. 10. — No. 5. — 2014. — P. 477486.

12. Kozine I. Krymsky V. Computing Interval-Valued Reliability Measures: Application of Optimal Control Methods // International Journal of General Systems. — Vol. 46. — No. 2. — 2017. — P. 144-157.

13. Ахмеджанов Ф.М., Крымский В.Г. Интервально-вероятностный алгоритм оценки человеческой надежности: новая модификация методики SPAR-H // Электротехнические и информационные комплексы и системы. — 2017. — Т. 13. — № 4.

— С. 81-91.

14. Carlson D.A., Haurie A.B., Leizarowitz A. Infinite Horizon Optimal Control: Deterministic and Stochastic Systems. — BerlinHeidelberg: Springer-Verlag, 1991. — 220 p.

References

1. Williams J.C. HEART — aproposed method for achieving high reliability in process operation by means of human factors engineering technology / J.C. Williams // Proceedings of a Symposium on the Achievement of Reliability in Operating Plant, Safety and Reliability Society (Southport, NC, the USA). — Elsevier, 1985. — P. 87-109.

2. Williams J.C. A data-based method for assessing and reducing human error to improveoperational performance // Proceedings of IEEE Fourth Conference on Human Factors in Power Plants (Monterey, CA, the USA). —

IEEE Cat. No. 88CH2576-7. — 1988. — P. 436450.

3. Calixto E. Gas and Oil Reliability Engineering: Modeling and Analysis / E. Calixto // Waltham (the USA): Gulf Professional Publishing, 2013. — 545 p.

4. Walley P. Statistical Reasoning with Imprecise Probabilities / P. Walley. — London: Chapman and Hall, 1991. — 719 p.

5. Kuznecov V.P. Interval’nye statisticheskie modeli. — M.: Sovetskoe radio. — 1991. — 352 p.

6. Utkin L.V. Kozine I.O. Different Faces of the Natural Extension // Proceedings of the 2nd International Symposium on Imprecise Probabilities and Their Applications. -Maastricht: Shaker Publ., 2001. — P. 316-323.

7. Krymsky V.G. Computing Interval Bounds for Statistical Characteristics Under Expert-Provided Bounds on Probability Density Functions // Lecture Notes in Computer Science.

— 2006. — Vol. 3732. — P. 151-160.

8. Kozine I.O. Krymsky V.G. Computing Interval-Valued Statistical Characteristics: What is the Stumbling Block for Reliability Applications? // International Journal of General Systems. — Vol. 38. — No. 5. — 2009. — P. 547565.

9. Kozine I., Krymsky V.G. Bounded densities and their derivatives: extension to other domains // Journal of Statistical Theory and Practice. — Vol. 3. — No. 1. — 2009. — P. 25-38.

10. Kozine I., Krymsky V. An interval-valued reliability model with bounded failure rates // International Journal of General Systems.

— Vol. 41. — No. 8. — 2012. — P. 760-773.

11. Krymsky V.G. Control Theory Based Uncertainty Model in Reliability Applications // International Journal of Performability Engineering. — Vol. 10. — No. 5. — 2014. — P. 477486.

12. Kozine I. Krymsky V. Computing Interval-Valued Reliability Measures: Application of Optimal Control Methods // International Journal of General Systems. — Vol. 46. — No. 2. — 2017. — P. 144-157.

13. Ahmedzhanov F.M., Krymskij V.G. Interval’no-verojatnostnyj algoritm ocenki chelovecheskoj nadezhnosti: novaja modifikacija metodiki SPAR-H // Elektrotehnicheskije i informacionnyje kompleksy i sistemy. — 2017.

— T. 13. — № 4. — P. 81-91.

iНе можете найти то, что вам нужно? Попробуйте сервис подбора литературы.

14. Carlson D.A., Haurie A.B., Leizarowitz A. Infinite Horizon Optimal Control: Deterministic and Stochastic Systems. — BerlinHeidelberg: Springer-Verlag, 1991. — 220 p.

Методологический подход к определению влияния человеческого фактора на работоспособность информационных систем

Время на прочтение

12 мин

Количество просмотров 18K

В статье изложен методологический подход к определению степени влияния человеческого фактора на функционирование больших информационных систем.

Введение

Современные информационные технологии и инновационные компьютерные и телекоммуникационные аппаратно-программные решения позволяют по-новому подойти к проблемам создания, сопровождения и модернизации больших корпоративных информационных систем.

Рассматривая такие системы, нельзя не учитывать роль человека, для облегчения труда которого, собственно, и создаются подобные системы. Человеко-машинная система, в которой человек или группа людей взаимодействует с техническим устройством в процессе производства материальных ценностей, управления, обработки информации, выполняет свои задачи благодаря совместной работе устройств и людей, которые рассматриваются как неотъемлемые составляющие части всей системы. При этом следует отметить, что любая такая система является уязвимой в силу своей зависимости от множества разнородных факторов.

По данным за период с 1996 г. Корпорации по исследованиям в области планирования на случай возникновения чрезвычайной ситуации в банках МВФ 10% угроз отказов информационных систем исходит от обслуживающего персонала. По другим данным американских источников, в целом степень влияния человеческого фактора на информационные системы еще выше и составляет до 30%, причем до 18% из них приходится на небрежное и халатное отношение к обработке или вводу информации.

Не менее важен вопрос защиты информационных систем от угроз, которым они могут подвергаться, и участия человека в этом вопросе. Согласно одному из проводимых опросов, проводимых в 2005 году, в России самой серьезной угрозой названы непреднамеренные ошибки сотрудников [5].

Человеко-машинная система — не автомат, поэтому одним из решающих факторов, влияющих на работу системы, является непредсказуемый человеческий фактор, оценке роли и важности которого и посвящена данная работа.

1. Основные понятия и определения

Любая большая информационная система не может полностью работать в автоматическом режиме. Всегда найдутся операции, которые в силу своей специфики невозможно или слишком «дорого» автоматизировать. Чем больше таких операций, особенно в основной технологической цепочке работы информационной системы, тем более зависимой она становится от индивидуальных свойств человека. Отметим ряд типичных характеристик человека, взаимодействующего с информационной системой, от которых зависит и его способность принимать решения в штатных и аварийных ситуациях.

- способность к адаптации,

- способность к утомлению,

- способность к отдыху,

- возможность совершения ошибки,

- способность принимать решения,

- способность запоминания информации,

- способность переносить информационную перегрузку,

- способность к обучению [1].

Рассмотрим количественную оценку влияния человеческого фактора на такое важное свойство, как доступность (или, что то же самое, коэффициент готовности) информационной системы.

Коэффициент готовности

Кг – вероятность того, что система окажется в работоспособном состоянии в произвольный момент времени. Это комплексная характеристика безотказности и ремонтопригодности системы, которая характеризуется показателями ремонтопригодности: То – среднее время наработки на отказ и Тв – среднее время восстановления после отказа.

Коэффициент готовности определяется как:

Доступность

(D) обычно в отличие от коэффициента готовности выражается в процентах, или D = Кг * 100 %.

Человеческий фактор влияет также на достоверность, своевременность и полноту обработки информации, вводимой и хранящейся в базе данных информационной системы. При длительном монотонном вводе данных, в процессе утомления человек начинает делать ошибки при вводе, пропускать данные, перестает укладываться во временные регламенты.

Учет такой характеристики, как способность к утомлению оценивается следующим образом. При работе в благоприятных условиях, средняя выработка в последние часы уменьшается на 6-7% за каждый час удлинения рабочего дня свыше 6 часов (т.е. за седьмой час производительность составляет 94%, за восьмой – 88%, за девятый – 81% и т.д.).

Степень влияния человеческого фактора на достоверность данных, вводимых в информационную систему при монотонном выполнении операции ввода, можно оценить, используя значения, приведенные в Таблице 1.

Таблица 1. Влияние человеческого фактора на достоверность ввода информации

| Время работы (часы работы) | ||||||

|---|---|---|---|---|---|---|

| 1-ый – 6-ой | 7-ой | 8-ой | 9-ый | 10-ый | 11-ый | |

| Производительность (% от нормы) | 100 | 94 | 88 | 81 | 74 | 67 |

| Процент безошибочности | 0,96 | 0,9 | 0,85 | 0,78 | 0,71 | 0,64 |

| Реальное время операции с учетом повторных работ (часов) |

6,25 | 1,11 | 1,18 | 1,28 | 1,4 | 1,56 |

| Достоверность результатов ввода (процент ошибок с учетом логических проверок и повторного ввода) |

0,999 | 0,996 | 0,994 | 0,991 | 0,988 | 0,985 |

| Верхняя граница достоверности | 0,9995 | 0,998 | 0,997 | 0,995 | 0,993 | 0,991 |

| Нижняя граница достоверности | 0,997 | 0,993 | 0,991 | 0,987 | 0,983 | 0,979 |

Одним из важных вопросов в обсуждаемой проблеме является вопрос «квалификации» сотрудника, обслуживающего информационную систему. Сотрудники с низкой квалификацией и новички должны обязательно проходить этапы обучения и тренировки работы с системой, которая, в свою очередь, должна быть хорошо документирована.

2. Методологический подход к определению влияния человеческого фактора на работоспособность информационной системы

Человек, как звено любой человеко-машинной системы, безусловно, влияет на показатели надежности и эффективности (полноты, достоверности, своевременности обработки информации) информационной системы в целом и ее отдельных подсистем и задач.Методология оценки влияния человеческого фактора на работу информационной системы является смешанной дисциплиной, в которой необходимо учитывать влияние ошибок человека на ее надежность, а также психологические особенности человека как звена это информационной системы.

Влияние человеческого фактора, а именно операторов, обслуживающего персонала сервисных центров и пр., на работу информационной системы может быть количественно определено степенью воздействия ошибок персонала на безопасность и производительность информационной системы.

Многие процессы в человеко-машинных системах содержат потенциальные возможности для ошибок персонала, в особенности в тех случаях, когда время, которым располагает оператор для принятия решений, ограничено. При этом вероятность того, что проблемы будут развиваться негативным образом, зачастую мала. Порой действия со стороны персонала ограничиваются возможностью предотвращения начальной неисправности, прогрессирующей в направлении аварийной ситуации.

Тем не менее, необходимо идентифицировать разнообразные типы ошибочных действий, которые могут иметь место, в том числе:

а) ошибка по оплошности, недосмотр, выразившийся в невыполнении требуемого действия информационной системы;

б) ошибка несоответствия, которая может предусматривать:

- положение, когда требуемое действие не выполняется должным образом (например, не выполнение регламента администрирования базы данных);

- действие, выполняемое слишком большим или слишком малым усилием, либо без требуемой точности (например, неточности при заполнении форм ввода, ошибки неточного ввода данных и т.д.);

- действие, выполняемое в неподходящее для него время (например, несвоевременный ввод информации, задержка обработки информации и т.д.);

- действие, выполняемое с нарушением очередности исполнения (например, подготовка итогового аналитического отчета при незавершенном процессе обработки данных);

в) лишнее действие, выполняемое вместо требуемого действия или в дополнение к нему (например, повторные вводы одних и тех же сведений, что может привести к расхождениям в сведениях или появлением дублирующих данных).

Степень влияния человеческого фактора на надежность системы можно оценить по вероятности проявления ошибок в процессе ручного ввода данных. Ошибка оператора всегда связана с неверной интерпретацией поступивших и анализируемых им данных. Считается, что для сложных технических приборов и сложных компьютерных задач вероятность ошибки может достигать 15%, для простых технических устройств и несложных компьютерных задач вероятность ошибки составляет от 1% до 5% [1].

Безошибочность действий оператора зависит от многих факторов:

- дефицит времени (частота совершения ошибок при обработке информации является логарифмической функцией скорости поступления информации);

- перегрузка информацией (количество ошибок возрастает при перегрузке, в частности, при увеличении числа источников информации);

- степень подготовки (более подготовленные специалисты совершают в среднем меньше ошибок);

- психологические особенности человека (кроме того, работа, выполняемая с интересом, как правило, менее ошибочна);

- «сенсорный голод» (увеличение частоты ошибок при длительном выполнении монотонной работы из-за малой нагрузки органов чувств).

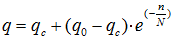

Важную роль в вопросе уменьшении количества ошибок играет степень подготовленности оператора. Считается [1], что в процессе обучения частота возникновения ошибок имеет тенденцию к уменьшению, причем эту зависимость можно аппроксимировать формулой:

, где

- q – частота ошибок после обучения;

- q0 – начальное значение частоты ошибок (до обучения);

- qc – установившееся стационарное значение частоты ошибок (для обученных операторов);

- n – накопленная сумма операций ввода, выполненных оператором в предыдущих циклах обучения (работы);

- N – «постоянная обучения», характеризующая продолжительность обучения оператора.

При n = N, разность (q0> – qc) уменьшается на 63%. Считается [1], что значение qc достигается через 4 – 5 N. При этом если обозначить за n1 – количество вводов информации, при котором выполняется q = qc, то:

Полученное значение N определяет необходимое количество вводов информации, составляющее один цикл обучения (тренировки) работы с информационной системой.

По экспериментальным данным, полученным при отработке операторами зрительных сигналов [3], вычислены следующие значения перечисленных выше параметров:

- q0 = 0,27 (новички, не умеющие работать с информационной системой),

- qc = 0,018 (операторы, прошедшие 4 и более тренировок)

В предположении, что совсем не обученных работе с информационной системой операторов, как правило, нет, процент ошибок q0 = 0,27 не достигается. За максимальное значение может быть принят показатель q01 = 0,15 (см. [2]).

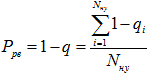

Тогда коэффициент учета ошибок этапа ручного ввода можно вычислить по формуле:

, где Pрв – вероятность безошибочности этапа ручного ввода оценивается для каждого ручного процесса отдельно; если процессы последовательные, коэффициенты перемножаются, т.е.

, где

- M – количество последовательных процессов ручного ввода,

- Nн.у.– количество операторов, по которым собрана статистика об ошибках.

Вероятность появления ошибки оператора существенно зависит от скорости поступления информации. Согласно [1], вероятность проявления ошибки в зависимости от скорости поступления информации V (бит/с) можно представить следующей формулой:

qрв = 9,7 10-4 V1,77

Важность задачи оценки влияния человеческого фактора может быть проиллюстрирована хотя бы аварийной ситуацией, имевшей место при эксплуатации одной из крупных распределенных информационных систем в августе 2005 года, когда ошибочные действия оператора привели к уничтожению рабочей базы данных, а ее восстановление заняло несколько дней. Ситуация была вызвана тем, что оператор в нарушение инструкции не создавал каждую неделю резервные копии базы данных, мотивируя это тем, операция резервного копирования требует длительного времени. Такого рода аварии (авторам известны более двух десятков подобных ситуаций, возникавших в разное время на реальных больших информационных систем) являются предостережением от тех оценок риска, которые концентрируют внимание исключительно на технических и программных средствах информационных систем и игнорируют ошибки персонала.

Кроме определения возможности возникновения катастрофических ситуаций вследствие влияния человеческого фактора, полезно определить ошибки, снижающие производительность, эффективность решения поставленной задачи в информационной системе.

Методологический подход к определению влияния человеческого фактора может включать в себя следующие этапы:

- анализ задачи или подсистемы информационной системы;

- определение степени загруженности задач и подсистем «ручными» операциями, выполняемыми персоналом;

- определение возможных ошибок персонала;

- количественное или качественное определение влияния человеческого фактора на надежность информационной системы и достоверность хранящейся в ней информации;

- рекомендации по автоматизации задач информационной системы, направленные на снижение влияния человеческого фактора.

На стадиях обследования «ручных» операций и выявления ошибок персонала идентифицируются и описываются возможные ошибочные действия при исполнении задачи. Определение ошибок персонала может включать выявление возможных последствий и причин ошибочных действий, а также предложение мер по снижению вероятности этой ошибки, совершенствованию перспектив для исправления и/или уменьшению последствий ошибочных действий. Результаты обследования «ручных» операций и рекомендации по их автоматизации, таким образом, обеспечивают ценный вклад в управление рисками в информационных системах даже в случае, если не проводится никакая количественная оценка влияния человеческого фактора.

Количественная оценка влияния человеческого фактора на надежность и эффективность информационной системы имеет целью оценить вероятности правильного выполнения той или иной задачи (P) или вероятности ошибочных действий (Q = 1 – P). Можно также предусматривать шаги по оценке вероятности или частоты определенных последовательностей нежелательных событий или нежелательных исходов.

Вероятность правильного выполнения оператором своей задачи Pрв во время выполнения ручной операции с обязательной проверкой в зависимости от степени подготовленности к работе с информационной системой, составляет

0,985 <= Pрв <= 0,999

или в среднем Pрв = 0,995

Другими словами, вероятность безошибочного выполнения ручной операции человеком (Pрв) будет находиться в диапазоне от 0,985 до 0,999 в зависимости от квалификации, степени утомления, степени перегруженности работой и пр. Вероятность совершения ошибки (Qрв) будет находиться в диапазоне от 0,001 до 0,015 (от 0,1% до 1,5% вводимых данных). Более полную зависимость Pрв от длительности выполнения монотонной работы можно посмотреть в Таблице 1.

Для ручных операций ввода данных, выполняемых в сложной задаче (большая информационная нагрузка, сложный интерфейс) без контрольной проверки, значения Pрв будут лежать в диапазоне от 0,85 до 0,982 [1, 2]. Иными словами, вероятность совершения ошибки (Qрв) будет находиться в диапазоне от 0,018 до 0,15 (от 1,8% до 15%). В простых задачах Qрв будет находиться в диапазоне от 0,01 до 0,05 (от 1% до 5%) .

В целом же для информационной системы и ее основных частей важно выявить степень зависимости ее отдельных задач и подсистем от операций, выполняемых «вручную», определить, можно ли автоматизировать ручные операции. Для операций, которые по каким-то причинам автоматизировать трудно (принципиальная невозможность, дороговизна работ по автоматизации), необходимо разработать организационные или другие меры, снижающие возможность влияния индивидуальных свойств человека на работу информационной системы (документирование, обучение, разработка кратких памяток и аварийных инструкций).

Основной возможностью снизить влияние человеческого фактора на систему, является автоматизация операций в системе, максимальное сокращение обязательных операций, выполняемых человеком.

Безусловно, имеются операции, которые автоматизировать невозможно или дорого по затратам ресурсов (например, не автоматизируемая семантическая операция и др.), но в этом случае, как правило, можно принять организационные и другие меры для снижения влияния человеческого фактора.

В случае отсутствия данных для точного определения уровня автоматизации можно использовать грубую качественную оценку степени загруженности задачи «ручными» операциями: «очень высокая», «высокая», «средняя», «низкая», а также оценку хорошо это или плохо для данной задачи или подсистемы. Предлагаемые оценки характеризуются оценкой процента выполняемых в задаче ручных операций, а также трудоемкостью ввода данных, сложностью работы с пользовательским интерфейсом, темпом выполнения работы.

Применение математического аппарата оценки достоверности данных в зависимости от ошибок ручного ввода, приведенного в [2], позволяет составить таблицу зависимости ошибок ручного ввода от степени загруженности задачи «ручными» операциями (см. Таблица 2). Вероятность ввода ошибочных сведений лежит в указанном диапазоне и зависит от квалификации оператора, степени усталости и скорости ввода информации.

В таблице, приведенной ниже, показана оценка возможного ошибочного ввода данных, в зависимости от внешних условий.

Таблица 2. Примерный процент сведений, содержащих ошибки в зависимости от степени загруженности задачи ручными операциями

| Степень загруженности задачи ручными операциями | Оценка процента ошибок ввода данных Qрв * | |

|---|---|---|

| Ручная операция выполнена с проверкой | Ручная операция выполнена без проверки | |

| Низкая | 0,0001 – 0,003 (0,01 – 0,3 %) |

0,01 – 0,05 (1 – 5 %) |

| Средняя | 0,001 – 0,010 (0,1 – 1,0 %) |

0,02 – 0,10 (2 – 10 %) |

| Высокая | 0,001 – 0,015 (0,1 – 1,5 %) |

0,02 – 0,12 (2 – 12 %) |

| Очень высокая | 0,003 – 0,022 (0,3 – 2,2 %) |

0,05 – 0,15 (5 – 15 %) |

* без учета влияния утомления на результаты работы

В свою очередь степень загруженности задачи (подсистемы) ручными операциями предлагается оценить следующим образом (см. Таблица 3). Таблицы ячейки заполняются по следующему принципу: в зависимости от оценки, указанной в заголовке колонки №3, строки колонки 3 заполняются нулем или единицей. Тогда последняя строка, содержащая сумму всех предыдущих, характеризует степень загруженности задачи ручными операциями.

Таблица 3. Оценка степени загруженности задачи ручными операциями

| № | Характеристика | Оценка: высокая – 1, низкая – 0 |

|---|---|---|

| 1 | Оценка количества выполняемых в задаче ручных операций | 0 или 1 |

| 2 | Трудоемкость ввода данных | 0 или 1 |

| 3 | Сложность работы с пользовательским интерфейсом | 0 или 1 |

| 4 | Темп выполнения «ручной» работы | 0 или 1 |

| 5 | Итого (степень загруженности): | 1 – Низкая 2 – Средняя 3 – Высокая 4 – Очень высокая |

Если каждую подсистему или задачу системы проанализировать согласно вышеприведенному алгоритму и заполнить для нее Таблицу 3, то можно оценить влияние человеческого фактора в рамках конкретной задачи (подсистемы) на достоверность вводимых данных (см. Таблица 2) и на показатели надежности системы в целом.

Используя данные, приведенные в Таблице 1, можно определить процент ошибок с учетом утомления человека в зависимости от времени работы.

Таким образом, приведенный выше методологический подход позволяет проводить оценку степени влияния человеческого фактора как для информационной системы в целом, так и для ее отдельных функций и подзадач используя данные, которые легко получить, не прибегая к методам статистического исследования.

Заключение

Общепризнано, что основные проблемы создания и внедрения информационных технологий в больших организационных системах сопряжены с влиянием человеческого фактора. [4] Более того, можно смело утверждать, что отсутствие оценки влияния этого показателя при проведении работ по анализу надежности, эффективности, целостности информационных систем, снижает точность получаемого результата.

Литература

- Дружинин Г.В. Человек в моделях технологий. Часть I: Свойства человека в технологических системах. – М.: МИИТ. 1996 – 124 с.

- Акимова Г.П., Соловьев А.В. Методология оценки надежности иерархических информационных систем. // Системный подход к управлению информацией. / Труды ИСА РАН. Т. 23. М.: КомКнига, 2006. С. 18 – 47.

- Цибулевский И.Е. Ошибочные реакции человека-оператора. – М.: Сов. Радио, 1979 – 208 с.

- Киреенко В.Е. Человеческий фактор корпоративных информационных систем (на примере Томского горисполкома). — Вестник Томского государственного университета №275, апрель 2002 г.

- Ветлугин К. Человеческий фактор. Computerworld №11, 2006

При анализе влияния

человека-оператора на надежность системы

должны учитываться его особые свойства,

такие как адаптивность, способность к

утомлению, отдыху, эмоциональным

реакциям, способность делать и исправлять

ошибки и другие свойства [8.2] .

Ввиду динамичности

и стохастичности этих свойств не

целесообразно ставить вопрос о показателях

надежности человека-оператора, аналогичных

показателям надежности технических

объектов. Вместе с тем свойства

человека-оператора необходимо учитывать

при рассмотрении путей повышения

надежности ИС. В первую очередь необходимо

учесть возможность ошибочных действий

человека и его способность компенсировать

последствия отказов технических объектов

и своих ошибок.

-

Показатели безошибочности человека-оператора

При идеальных

условиях работы хорошо обученные

операторы делают в среднем не менее

одной ошибки на 1000 операций; при стрессовых

ситуациях — в среднем одну ошибку на 10

операций. Принято выделять два вида

ошибок оператора: пропуски сигналов и

искажения сигналов.

В качестве

характеристики безошибочности работы

оператора применяют [8.2] частоту

(вероятность) появления ошибок.

Статистическое

значение

частоты ошибок в i—

м опыте

![]() ,

,

(8.1)

где ni

— количество предъявленных оператору

сигналов I

опыте; mi

— количество ошибок оператора в этом

опыте.

В процессе обучения

частота ошибок обычно уменьшается.

Оператор считается обученным, если

частота уменьшилась до установившегося

значения qс.

Считается, что процесс обучения

достаточно хорошо аппроксимируется

экспоненциальной зависимостью:

![]() ,

,

(8.2)

где q0

– начальное (до обучения) значение

частоты ошибок; n

— накопленная сумма предъявленных

оператору сигналов в предыдущих опытах

и половина числа сигналов в данном

опыте; N

— «постоянная обучения», то есть

некоторое среднее характеристическое

число опытов. При n

= N

разность

(![]() )

)

уменьшается на 63%. Считается, что

значениеqc

практически

достигается при n

= (4…5)N.

Стабильность

обучения операторов характеризуется

средним квадратическим отклонением

статистических частот ошибок

![]() от экспонентыq

от экспонентыq

(n):

![]() ,

,

(8.3)

где

![]()

![]() — статистическое значение частоты ошибок

— статистическое значение частоты ошибок

вi–м

опыте ,

![]() — соответствующее аппроксимирующее

— соответствующее аппроксимирующее

значение;k

— число опытов.

Согласно

экспериментальным данным [8.2] распределение

частоты ошибочных реакций человека-оператора

на зрительные и звуковые сигналы является

модальным с положительной асимметрией:

вероятность появления соответствующей

частоты быстро увеличивается до

модального значения, затем медленно

уменьшается в области больших частот.

В ходе экспериментов по обработке

операторами зрительных сигналов получены

следующие средние значения перечисленных

выше параметров: q0

ср= 0,27; qc

ср= 0,018; Nср

= 1400; σср

= 0,024.

8.2.2. Способы борьбы с ошибками оператора

Можно различать

две группы способов борьбы с ошибками

операторов: способы уменьшения количества

ошибок и способы защиты от ошибок.

К числу наиболее

часто применяемых способов

уменьшения количества ошибок операторов

относится:

блокировка нежелательных действий,

резервирование действий, контроль

состояния операторов, организационные

и психологические мероприятия.

Для блокировки

нежелательных действий

операторов органы управления проектируются

так, чтобы исключить возможность

осуществления оператором этих действий.

Резервирование

действий состоит во введении дополнительных

действий перед основными. Например, для

уменьшения возможных ошибок при

использовании оружия его нужно перед

применением снять с предохранителя.

Предохранители имеются у наиболее

важных кнопок, рукояток.

Возможность

появления ошибок может значительно

увеличиваться при некоторых состояниях

человека-оператора. Поэтому эффективный

путь снижения количества ошибок

операторов – текущий

контроль состояния операторов в процессе

работы. В

первую очередь контролируются внимание

и эмоциональное напряжение. Возможны

три пути осуществления текущего контроля

операторов:

-

контроль по

результатам действий. Этот вид контроля

применяется лишь в процессе тренировок

или отбора операторов; -

посылка контрольных

сигналов (тестов) одновременно с

основными сигналами, необходимыми для

управления объектом. По ответным

реакциям определяется состояние

оператора. При необходимости функции

оператора передаются дублеру или

изменяется режим работы. Этот путь

контроля имеет следующие недостатки:

а) отвлекает оператора от его основной

деятельности, создает дополнительную

перегрузку; б) снижает ответственность

за результаты действий, так как оператор

знает, что не все сигналы нужны для

управления; в) истинное состояние

оператора могут маскировать его

намеренные усилия эффективно реагировать

на сигналы (как основные, так и

контрольные); в результате возможен

внезапный срыв; -

слежение за

физиологическими функциями оператора,

объективно регистрируемыми в процессе

его текущей деятельности. При этом

анализируют непроизвольные сдвиги

физиологических параметров, которые

обычно стараются характеризовать

электрическими сигналами.

Состояние человека

является результатом сложного

взаимодействия со средой. Из-за наличия

многих возмущающих воздействий

физиологические процессы являются

случайными функциями времени. Для оценки

состояния оператора вычисляются и

анализируются характеристики этих

случайных процессов.

Кроме перечисленных

технических приемов существует ряд

психологических

и организационных мероприятий,

направленных на уменьшение количества

ошибок операторов. Эти мероприятия

учитывают, что на безошибочность работы

операторов оказывают влияние следующие

факторы: 1) «степень согласованности»

возможностей человека и конструкции

технических устройств; 2) дефицит времени,

ведущий к увеличению интенсивности

ошибок; 3)значительное возрастание

количества ошибок при увеличении числа

источников информации, которые должен

использовать оператор; 4) малая нагрузка

органов чувств, увеличивающая количество

ошибок; 5) субъективные психологические

особенности операторов.

Наряду с мероприятиями

по уменьшению количества ошибок

операторов необходимы действенные меры

по защите от появляющихся ошибок;

к числу таких мер относятся резервирование

операторов и создание специальных

систем защиты от ошибок.

Резервирование

операторов

во многом аналогично мажоритарному

резервированию технических объектов.

Параллельно выполняют одинаковые задачи

несколько операторов и результаты

сравнивают; при несовпадении результатов

ищут и устраняют причины ошибки, вновь

выполняют работу и сравнивают результаты

и т. д. Такое резервирование операторов

эффективно при независимых ошибках

многих видов. Учитывая многообразие

видов ошибок, часто можно пренебречь

вероятностями появления одинаковых

ошибок и считать, что результаты действий

операторов совпадают лишь при отсутствии

ошибок. При значительной корреляции

между ошибками операторов их резервирование

не эффективно.

Системы защиты

от ошибок

во многом аналогичны системам защиты

от несанкционированного доступа к

данным. Важнейшей составной частью

таких систем является подсистема

контроля, выявляющая с достаточно

высокой вероятностью количество ошибок.

Кроме того, в систему защиты от ошибок

входит подсистема исправления ошибок.

В качестве показателя

надежности функционирования системы

защиты от ошибок может быть принята

условная вероятность преодоления

системы защиты при условии, что оператор

совершил ошибку (несанкционированное

действие).

______________________________

-

Мунипов В.М.

Эргономика: человекоориентированное

проектирование техники, программных

средств и среды: учебник для вузов /

В.М. Мунипов, В. П. Зинченко. М.: Логос,

2001. -

Дружинин Г.В.

Надежность автоматизированных

производственных систем / Г.В. Дружинин.

М. : Энергоатомиздат, 1986.

Соседние файлы в предмете [НЕСОРТИРОВАННОЕ]

- #

- #

- #

- #

- #

- #

- #

- #

- #

- #

- #