Copyright © 2023 Synology Inc. Все права защищены.

Положения и условия

|

Конфиденциальность

|

Настройки файлов cookie

|

Россия — Русский

Copyright © 2023 Synology Inc. Все права защищены.

Положения и условия

|

Конфиденциальность

|

Настройки файлов cookie

|

Россия — Русский

Руководство пользователя Synology NAS

Под управлением DSM 6.2

31 Глава 5: Управление объемом хранения

Расширение пула ресурсов хранения путем замены дисков

Для SHR, RAID 1, RAID 5, RAID 6, RAID 10 и RAID F1 емкость пулов ресурсов хранения можно расширить

путем замены жестких дисков меньшего объема на диски большего объема. При расширении емкости с

помощью этого метода необходимо заменять жесткие диски по одному. После замены одного жесткого

диска пул ресурсов хранения необходимо восстановить, прежде чем приступать к замене следующего

жесткого диска. Для получения дополнительных инструкций см. Справку DSM.

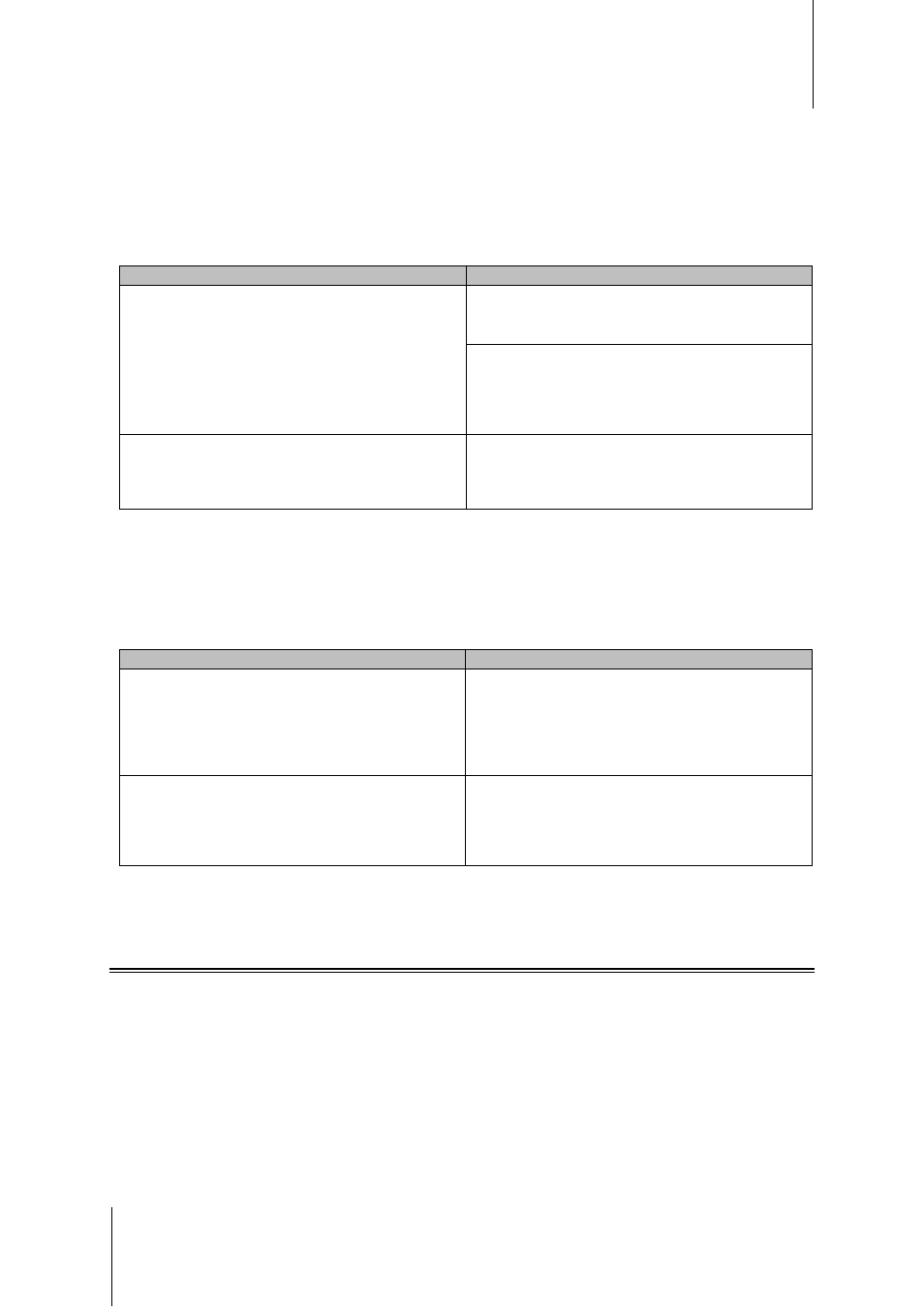

Какой жесткий диск необходимо заменить первым, см. в следующей таблице.

SHR (Synology Hybrid RAID)

Если емкость всех дисков одинакова, следует заменить

не менее двух дисков. В противном случае емкость

пула ресурсов хранения не увеличится.

Если емкость жестких дисков различна, то новые диски

должны быть не меньше самого большого из

существующих дисков. Помимо этого, для оптимизации

использования хранилища сначала нужно заменить

диски самого малого объема.

RAID 1, RAID 5, RAID 6, RAID 10

При замене жестких дисков в пулах ресурсов хранения

данных типов RAID сначала необходимо заменить диск

самой меньшей емкости для максимального

использования диска.

Расширение пула ресурсов хранения путем добавления дисков

Для SHR, JBOD, RAID 5, RAID 6 и RAID F1 емкость хранилища для пулов ресурсов хранения можно

расширить, добавив дополнительные жесткие диски, если в Synology NAS есть пустые отсеки для жестких

дисков. Для получения дополнительных инструкций см. Справку DSM.

Сведения о минимальном размере новых жестких дисков см. в следующей таблице.

Минимальный размер жесткого диска

SHR

Емкость добавляемого диска должна быть не меньше

самого большого диска в пуле ресурсов хранения или

быть равной любому диску в пуле ресурсов хранения.

Например, если том SHR состоит из трех дисков

емкостью 2, 1,5 и 1 ТБ, то емкость нового диска должна

быть не меньше 2 ТБ или равняться 1,5 ТБ либо 1 ТБ.

RAID 5, RAID 6, RAID F1

Емкость добавляемого диска должна быть не меньше

самого малого диска в пуле ресурсов хранения.

Например, если том состоит из трех дисков емкостью 2,

1,5 и 1 ТБ, то емкость нового диска должна быть не

меньше 1 ТБ.

Исправление ошибок данных файловой системы или

RAID

Исправление ошибок данных файловой системы или RAID — это функция организации данных,

позволяющая проверять пулы ресурсов хранения и устранять обнаруженную несогласованность данных.

Функцию исправления ошибок данных RAID можно использовать с пулами ресурсов хранения,

использующими SHR (из трех или более дисков), RAID 5, RAID 6 или RAID F1. Исправление ошибок

данных файловой системы можно выполнить только на томах в файловой системе Btrfs.

Рекомендуется регулярно выполнять исправление ошибок данных RAID или файловой системы, чтобы

поддерживать их согласованность и избежать утери критически важных данных в случае отказа диска.

Для получения дополнительных инструкций см. Справку DSM.

Уважаемый Igr_ua

Благодарю за терпение и потраченное на меня время.

Пожалуйста ![]()

Теперь к вопросам…

(пока собирался, на часть вопросов ответы уже дали)

Прежде всего внимательно изучаем содержимое файла /etc/fstab и содержимое файла /proc/mdstat. Если нужно, то записываем на листик исходные данные.

Из этих файлов вы узнаете много нужного в дальнейшем (пример содержимого файлов здесь

Проверка RAID разделов NAS на ошибки файловой системы

1. Останавливаем все сервисы

Как? Тупо из web интерфейса? Или есть какие-нибудь волшебные команды?

Да. Тупо из интерфейса.

2. Проверяем под каким номером RAID

mdadm -D /dev/md0 (md1, md2 и т.д.)

это мы уже узнали из файлов /etc/fstab и /proc/mdstat, но можно и проверить

2. Отмонтируем раздел

umount /volume1

Как определить правильно какую циферку ставить после volume? Если у меня в менеджере хранение написано «раздел 1» то и в этой команде тоже должно быть volume1?

Это тоже видно из тех же файлов.

Иногда может возникнуть ситуация, что раздел не захочет размонтироваться. Вроде бы и все сервисы остановили, пакеты отключили, но….

Тогда, заходим в терминал (через putty или кому как удобней) и смотрим активные процессы.

Это можно сделать с помощью команды Top либо ps.

после этого останавливаем процесс:

killall имя_процесса

3. Останавливаем RAID

mdadm -S /dev/md0

4. Проверяем раздел

e2fsck -f /dev/md0

если e2fsck отработала и вернула код «0» — значит все в порядке.

Запуск проверки раздела с автоматическим исправлением ошибок

e2fsck -p /dev/md0

да.

5. Монтируем раздел обратно

mount /dev/md0 /volume1

не получится, т.к. перед этим необходимо собрать массив

Create — создание RAID-массива из нескольких дисков (с суперблоком на каждом устройстве).

Assemble — сборка (ранее созданного) массива и его активация. Диски из которых собирается массив могут указываться явно или будет выполнен их автоматический поиск. mdadm проверяет, образуют ли компоненты корректный массив.

Пример:

mdadm —assemble -R —force /dev/md3 /dev/sdc3 /dev/sdd3

mdadm -Cf /dev/md2 -R -n 3 —level=linear /dev/sda3 /dev/sdb3 /dev/sdc3 /dev/sdd3 (это пример… не повторять буквально!!!!)

пример для массива JBOD — здесь — пункты 7-12

Вот после этого, когда собрали массив, монтируем его в систему.

6. Запустить все службы и программы на NAS

Как? И нужно ли? Может просто перезагрузить NAS?

Это зависит от того, какие цели вы преследуете.

Когда мне надо было вытаскивать данные, то я коробку не перегружал.

Если вам работать как обычно — лучше перегрузить (мало ли какие процессы вы пришибли вручную в п.2)

7. Перезагрузить NAS.

где-то так….

з.ы. про mdadm — тут

Осталось в заключении добавить, что все что вы делаете с собственным массивом, вы делаете на собственный страх и риск… ![]()

Как сказал Daxlerod, вам следует использовать инструменты SMART, однако вам также необходимо выполнить то, что называется очисткой данных.

Если вы еще этого не сделали, создайте группу дисков. Чтобы очистка данных была доступна, вам нужно как минимум 3 диска, по крайней мере, 1 резервный диск и как минимум 2 диска с данными. Подождите, пока группа дисков полностью синхронизируется, затем выполните очистку данных.

Начиная с версии Synology OS v4.2, очистка данных доступна из

Storage Manager -> Disk Group -> Manage -> Start data scrubbing

Это займет часы, поскольку он читает все сектора всех дисков и выполняет некоторые математические операции, чтобы увидеть, правильно ли складываются данные контрольной суммы. Вы можете использовать NAS, пока это происходит, но это будет немного медленнее. Многие люди запускают очистку данных раз в месяц. Лично я выполняю очистку данных один раз в неделю, а рабочую — в выходные, а домашнюю — в течение недели, пока я на работе.

Есть хорошая статья под названием Scrub Synology RAID-диски, в которой также рассказывается, как запустить средство проверки файловой системы, называемое fsck, даже если в веб-интерфейсе для этого нет опции.

Изменить: вышеуказанная страница, кажется, ушел, но в основном сказал

Команды для выполнения автономного fsck:

syno_poweroff_task fsck.ext4 -pvf /dev/vg[x]/volume_[y]Задача отключения питания выполняет некоторые размонтирования (том 1 и т.д.). Затем вы выполняете обычный Linux fsck.

Однако, читая еще несколько страниц, таких как https://forum.synology.com/enu/viewtopic.php?f=39&t=83186 и http://www.cyberciti.biz/faq/synology-complete-fsck-file-system- check-command/ кажется, что они изменились в DSM 5+. Кто-то предлагает использовать опцию -d (отладка) в задаче выключения, например

syno_poweroff_task -d

В то время как сайт киберцити предлагает использовать lsof, чтобы найти то, что использует том, используйте сценарии отключения службы в /usr/syno/etc/rc.d/ перед использованием команды umount .

Обратите внимание, что все это требует, чтобы вы вошли в окно NAS, если вам не нравится командная строка linux, а затем, возможно, сделайте запрос в Synology, чтобы добавить кнопку fsck в веб-интерфейс.

Руководство пользователя Synology NAS

Под управлением DSM 6.2

32 Глава 5: Управление объемом хранения

SSD TRIM

Если том состоит только из SSD (твердотельных накопителей), рекомендуется включить SSD TRIM.

Данная функция позволяет повысить скорость чтения и записи томов, созданных на SSD, что позволит

повысить эффективность и срок службы SSD.

Перед настройкой SSD TRIM ознакомьтесь с подробными инструкциями и дополнительными

ограничениями в

Справке DSM

.

Примечание.

Функция SSD TRIM доступна только на некоторых моделях Synology NAS и типах RAID.

Некоторые модели SSD не поддерживают выполнение SSD TRIM на томах RAID 5 и RAID 6. См. список

совместимости на веб-сайте

www.synology.com

.

Управление жесткими дисками

На вкладке

HDD/SSD

можно отслеживать состояние жестких дисков, установленных в Synology NAS, а

также организовывать и анализировать производительность и состояние дисков. Чтобы открыть эту

вкладку, выберите

Диспетчер хранения

и нажмите

HDD/SSD

. Для получения дополнительных

инструкций см.

Справку DSM

.

Включение поддержки записи в кэш

Включение поддержки записи в кэш повышает производительность Synology NAS. Эта функция

поддерживается только для некоторых моделей жестких дисков. Для обеспечения защиты данных при

поддержке записи в кэш настоятельно рекомендуется использовать устройство ИБП. Также

рекомендуется правильно выключать систему после каждого использования. Отключение записи в кэш

уменьшит вероятность потери данных при сбое питания, но сократит производительность.

Запуск тестов S.M.A.R.T.

Тесты S.M.A.R.T. для дисков изучают жесткий диск и сообщают о его состоянии, предупреждая о

возможных сбоях диска. При обнаружении ошибок рекомендуется сразу заменить диск. Также можно

запланировать автоматическое выполнение тестов S.M.A.R.T., создав задачи.

Проверка информации о диске

В разделе

Диспетчер хранения

>

HDD/SSD

>

HDD/SSD

нажмите стрелку вниз рядом с именем жесткого

диска, чтобы просмотреть название модели, серийный номер, версию микропрограммы и общий размер

жесткого диска.

Кэш SSD

Диски с кэшем SSD

1

можно установить и монтировать в конфигурации только для чтения (RAID 0) или

чтения-записи (RAID 1, RAID 5, RAID 6), чтобы увеличить скорость чтения и записи для тома. В разделе

Диспетчер хранения

>

Кэш SSD

можно создать кэш и просмотреть информацию о нем.

Сведения об установке SSD см. в Руководстве по установке оборудования для вашей модели Synology

NAS. Для получения дополнительных сведений об управлении SSD см.

Справку DSM

или

Техническую

документацию по кэшу SSD Synology

.

———

1

Кэш SSD поддерживается только в некоторых моделях. Для получения дополнительной информации посетите

страницу

www.synology.com

.

How to properly do a filesystem check (fsck or e2fck) on Synology DSM 6.0 e.g. DS414

I tried a lot of instructions and tutorials to do a file system check on a Synology DSM 6 device e.g the DS414.

The first step involves unmounting the partition you want to check e.g. the /volumes/ path before you can file system check it.

All the instructions I found are inaccurate, too old (most are for DSM 4 or 5), do not work or a dangerous. I just could not get the unmounting to work!

Presteps are install ipckg using instructions found here: https://github.com/basmussen/ds414-boostrap-dsm5

then install the packages less, lsof, mlocate

E.g. the common advice:

shuts down all services including telnet and the web interface etc. but it also shutsdown my ssh server and the webserver making the box completely inaccessible while still powered on -> you need to hard reset the box

the other common advice to just do a

and then kill the PID of the processes using the volume. Problem with this is that most services are watched by the system so if you kill them, they just restart again after a sec.

Here is my solution:

Get the list of services associated with your volume you want to fs check:

Or make the list more clear with:

lsof /volume1/ | sed 1d | cut -d" " -f1 | sort | uniq

e.g.

anvil

ash

cnid_dbd

cut

dovecot

img_backu

log

master

php56-fpm

pickup

postgres

qmgr

s2s_daemo

sed

sh

sort

syno_mail

afpd

cnid

If you are a bit into Linux you can spot/group these services into categories:

php5/httpd/apache2/nginx = searchterms httpd,nginx

postgres = searchterms postgres

dovecot/syno_mail = searchterm mail

...

to generally find services by name use the following syntax

find /usr/syno/etc.defaults/rc.sysv/ | grep -i <service name>

synoservicecfg --status | grep enable | grep -i <service name>

e.g.

find /usr/syno/etc.defaults/rc.sysv/ | grep -i postgres

synoservicecfg --status | grep enable | grep -i nginx

So my approach was to spot a service which sounds promising, stop it and then run

lsof /volume1/ | sed 1d | cut -d" " -f1 | sort | uniq to see if this service vanishes from the list.

So all in all I found the following services which I had to stop.

shutdown postgres — postgesql

/usr/syno/etc.defaults/rc.sysv/pgsql.sh stop

stop php5

synoservicecfg --stop pkgctl-PHP5.6

shutdown Mailserver

synoservicecfg --stop pkgctl-MailServer

shutdown backups (img_backu)

synoservicecfg --stop synobackupd

synoservicecfg --stop pkgctl-HyperBackupVault

synoservicecfg --stop pkgctl-synobackupd

synoservicecfg --stop pkgctl-HyperBackup

synoservicecfg --stop pkgctl-HyperBackupVault

synoservicecfg --stop pkgctl-TimeBackup

shutdown s2sdaemon

synoservicecfg --stop s2s_daemon

others: afp and cnid_dbd

Since I could not find any service definition file for those I simply killed the processes using good old kill command, which did not restart luckily within a minute or so.

disconnect the system user

now the last thing what was still in the list were some user cwd processes connected, as the /home folder was part of the /volumes1 folder:

sh 8480 Oli cwd DIR 253,1 4096 154796037 /volume1/homes/Oli

sudo 9104 root cwd DIR 253,1 4096 154796037 /volume1/homes/Oli

ash 9105 root cwd DIR 253,1 4096 154796037 /volume1/homes/Oli

lsof 9209 root cwd DIR 253,1 4096 154796037 /volume1/homes/Oli

lsof 9209 root txt REG 253,1 125544 369233175 /opt/sbin/lsof

lsof 9210 root cwd DIR 253,1 4096 154796037 /volume1/homes/Oli

lsof 9210 root txt REG 253,1 125544 369233175 /opt/sbin/lsof

Solution here was to logout your user and login the true root user using sshthen you can finally umount those beasts:

umount /opt

umount /volume1

then finally run your fsck diagnostic etc.

fsck.ext4 -fv /dev/mapper/vol1-origin

done!

Руководство пользователя

Synology NAS

Под управлением DSM

6.1

37

Глава 6: Управление объемом хранилища с помощью блоков RAID Group10F

Расширение блоков RAID Group

Емкость хранения блоков RAID Group можно постепенно расширять, устанавливая дополнительные

жесткие диски или диски большего размера. Благодаря этой функции можно расширить емкость RAID

Group дисков в соответствии с бюджетом, не опасаясь за возможную потерю данных.

В разделах ниже приводятся базовые сведения о расширении блоков RAID Group. Для получения

дополнительных инструкций см.

Справку DSM

.

Расширение блоков RAID Group путем установки жестких дисков большего

размера

Можно расширить емкость хранения блоков RAID Group, заменив существующие жесткие диски на диски

большего размера. Данная функция доступна для RAID 1, RAID 5 и RAID 6. Связанные тома или iSCSI

LUN

на RAID Group для одного тома или iSCSI LUN будут расширены автоматически.

Расширение блоков RAID Group путем установки дополнительных жестких

дисков

Можно расширить емкость хранения блоков RAID Group, устанавливая и добавляя дополнительные

жесткие диски. Данная функция доступна для JBOD, RAID 5 и RAID 6.

Для блоков RAID Group с общей емкостью менее 64 ТБ система увеличивает емкость автоматически. Для

блоков RAID Group с общей емкостью более 64 ТБ выберите

Управление

>

Расширить

, чтобы увеличить

емкость RAID Group.

Исправление ошибок данных файловой системы или

RAID

Исправление ошибок данных файловой системы или RAID — это функция организации данных,

позволяющая проверять тома или группы дисков и устранять обнаруженную несогласованность данных.

Исправление ошибок данных RAID можно использовать с томами или группами дисков, использующими

SHR (из трех или более дисков), RAID 5 или RAID 6. Исправление ошибок данных файловой системы

можно выполнить только на томах в файловой системе Btrfs. Рекомендуется регулярно выполнять

исправление ошибок данных RAID или файловой системы, чтобы поддерживать их согласованность и

избежать утери критически важных данных в случае отказа диска.

Для получения дополнительных инструкций по исправлению ошибок данных RAID или файловой системы

см.

Справку DSM

.

Управление томами

Тома являются базовыми пространствами хранения, на которых пользователь может создавать общие

папки, iSCSI LUN (обычный файл), сохранять данные и устанавливать пакеты. Перед созданием тома в

Synology NAS сначала создайте хотя бы один блок RAID Group.

Создание томов

Чтобы создать тома, выберите

Диспетчер хранения

>

Том

и нажмите

Создать

. Для получения

дополнительных инструкций см.

Справку DSM

.

Руководство пользователя Synology NAS

Под управлением DSM 6.2

31 Глава 5: Управление объемом хранения

Расширение пула ресурсов хранения путем замены дисков

Для SHR, RAID 1, RAID 5, RAID 6, RAID 10 и RAID F1 емкость пулов ресурсов хранения можно расширить

путем замены жестких дисков меньшего объема на диски большего объема. При расширении емкости с

помощью этого метода необходимо заменять жесткие диски по одному. После замены одного жесткого

диска пул ресурсов хранения необходимо восстановить, прежде чем приступать к замене следующего

жесткого диска. Для получения дополнительных инструкций см.

Справку DSM

.

Какой жесткий диск необходимо заменить первым, см. в следующей таблице.

Тип RAID

Примечания

SHR (Synology Hybrid RAID)

Если емкость всех дисков одинакова, следует заменить

не менее двух дисков. В противном случае емкость

пула ресурсов хранения не увеличится.

Если емкость жестких дисков различна, то новые диски

должны быть не меньше самого большого из

существующих дисков. Помимо этого, для оптимизации

использования хранилища сначала нужно заменить

диски самого малого объема.

RAID 1, RAID 5, RAID 6, RAID 10

При замене жестких дисков в пулах ресурсов хранения

данных типов RAID сначала необходимо заменить диск

самой меньшей емкости для максимального

использования диска.

Расширение пула ресурсов хранения путем добавления дисков

Для SHR, JBOD, RAID 5, RAID 6 и RAID F1 емкость хранилища для пулов ресурсов хранения можно

расширить, добавив дополнительные жесткие диски, если в Synology NAS есть пустые отсеки для жестких

дисков. Для получения дополнительных инструкций см.

Справку DSM

.

Сведения о минимальном размере новых жестких дисков см. в следующей таблице.

Тип RAID

Минимальный размер жесткого диска

SHR

Емкость добавляемого диска должна быть не меньше

самого большого диска в пуле ресурсов хранения или

быть равной любому диску в пуле ресурсов хранения.

Например, если том SHR состоит из трех дисков

емкостью 2, 1,5 и 1 ТБ, то емкость нового диска должна

быть не меньше 2 ТБ или равняться 1,5 ТБ либо 1 ТБ.

RAID 5, RAID 6, RAID F1

Емкость добавляемого диска должна быть не меньше

самого малого диска в пуле ресурсов хранения.

Например, если том состоит из трех дисков емкостью 2,

1,5 и 1 ТБ, то емкость нового диска должна быть не

меньше 1 ТБ.

Исправление ошибок данных файловой системы или

RAID

Исправление ошибок данных файловой системы или RAID — это функция организации данных,

позволяющая проверять пулы ресурсов хранения и устранять обнаруженную несогласованность данных.

Функцию исправления ошибок данных RAID можно использовать с пулами ресурсов хранения,

использующими SHR (из трех или более дисков), RAID 5, RAID 6 или RAID F1. Исправление ошибок

данных файловой системы можно выполнить только на томах в файловой системе Btrfs.

Рекомендуется регулярно выполнять исправление ошибок данных RAID или файловой системы, чтобы

поддерживать их согласованность и избежать утери критически важных данных в случае отказа диска.

Для получения дополнительных инструкций см.

Справку DSM

.

Пару недель как начала появляться ошибка:

«В разделе 1 обнаружена ошибка файловой системы»

SMART и состояние жестких дисков — в норме. Но ошибка не уходит, не помогает ни ребут наса, ни проверка. Обратил внимание на надпись (см. скрин) «Исправление ошибок данных файловой системы не поддерживается» файловая система EXT4.

Неужели это ограничения EXT4 и как Как можно исправить?

Диски собраны в RAID10.

На самосборном NAS-е установлена DSM 5.2-5967, загрузка через XPEnoboot_DS3615xs_5.2-5967.1.

В системе 8 дисков по 4 ТБ, RAID6.

Единственное применение этого НАС-а — ежедневные бэкапы с других серверов SYNOLOGY, больше на нем ничего не крутится, совсем.

В какой-то момент один диск отказал (Crashed), и том вошел в статус Degraded.

И тут же посыпались ошибки файловой системы ![]()

Появляется окно File System Check, перезагружаю систему, она довольно долго что-то делает, потом опять становится доступной, но почти сразу после загрузки опять появляется это окно.

И так продолжается уже довольно долго.

При этом все бэкапы кроме одного единственного продолжают нормально бэкапиться и добавляться (все бэкапы инкрементные).

И только с одним проблемы — при очередной попытке сделать бэкап выдается ошибка, а на этом сервере бэкапов снова вылезает окно об ошибках файловой системы.

Кто с таким сталкивался? Что делать?

Может быть есть возможность как-то руками запустить полную проверку файловой системы из командной строки, залогинившись под админом?

P.S.

Немаловажное уточнение: этот проблемный бэкап — это бэкап корпоративной почты.

Там есть папка с аттачами, в которой на данный момент находится более 250 тысяч файлов общим объемом 190 гигов.

Может быть дело в этой папке?

Но в то же время на другом аналогичном сервере она работает каждый день, и проблем с ней до сих пор (3*тьфу) не возникало.

P.P.S.

Примерно месяц назад такая же проблема была еще с одним бэкапом на этом же сервере, но тот бэкап был ничем не примечателен.

Дело кончилось тем, что пришлось грохнуть весь куст бэкапов за год (там было около 280 последовательных бэкапов), и начать все заново.

Но это же не выход?

Помогите пожалуйста решить проблему. Что-то непонятное творится ![]()

P.P.P.S.

В официальную техподдержку уже обращался, но там сразу затребовали серийник.

Давать им серийник от реально работающего другого нашего настоящего сервера Synology я что-то постеснялся,

поэтому переписку пришлось прервать и сказать что бэкапы грохнули и работаем дальше ![]()